LLMの登場でソフトウェア開発の世界は劇的に変わりました。コード生成、ドキュメント作成、アイデア出し… これまで数時間かかっていた作業が、ものの数分で完了する。そんな未来が現実のものとなり、多くの開発現場で生産性の向上が期待されています。

しかし、実際にLLMを本格導入してみると、多くのエンジニアがこんな壁にぶつかっているのではないでしょうか。「実装は確かに早くなった。でも、なぜかプロジェクト全体は遅々として進まない…」と。

実はこれ、LLM導入後によく見られる現象で、開発プロセスの ボトルネックが移動した ことが原因なんです。本記事では、私自身の失敗談も交えながら、LLM導入後に現れる「新たなボトルネック」を特定し、その具体的な解決策を実践的なコードと共に徹底解説します。

なぜボトルネックは移動したのか? LLM開発の新たな現実

LLMは銀の弾丸ではありませんでした。これは、私がLLMを本格的にプロジェクトに導入して最初に得た、最も重要な教訓です。当初、私は「実装」フェーズが劇的に短縮されることで、開発プロセス全体が高速化されると信じていました。しかし、現実は少し違ったのです。

以下の図を見てください。これは、従来の開発プロセスとLLM導入後のプロセスにおける、工数の変化を模式的に表したものです。

ご覧の通り、LLMの活用で「実装」にかかる時間は大幅に削減されました。しかし、その分「レビュー・QA」と「テスト」の工数が膨れ上がっているのがわかります。LLMが生成したコードは一見正しく見えても、細かなバグや意図しない挙動、セキュリティ上の脆弱性を内包していることが少なくありません。また、プロンプトの些細な変更が出力に大きな影響を与えるため、その調整と品質担保に膨大な時間を費やすことになったのです。

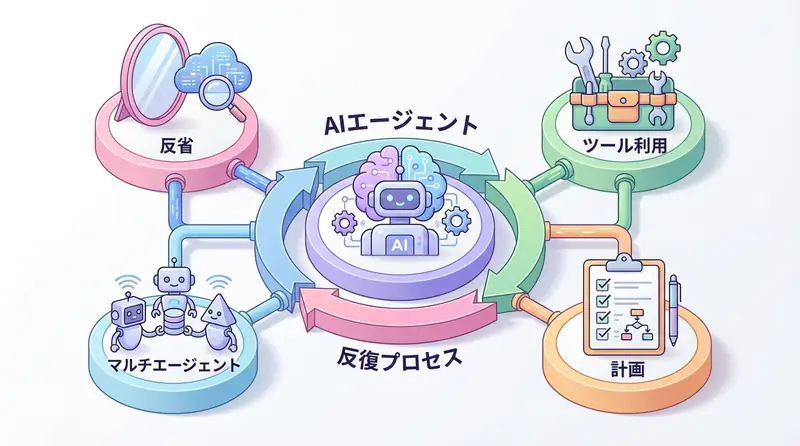

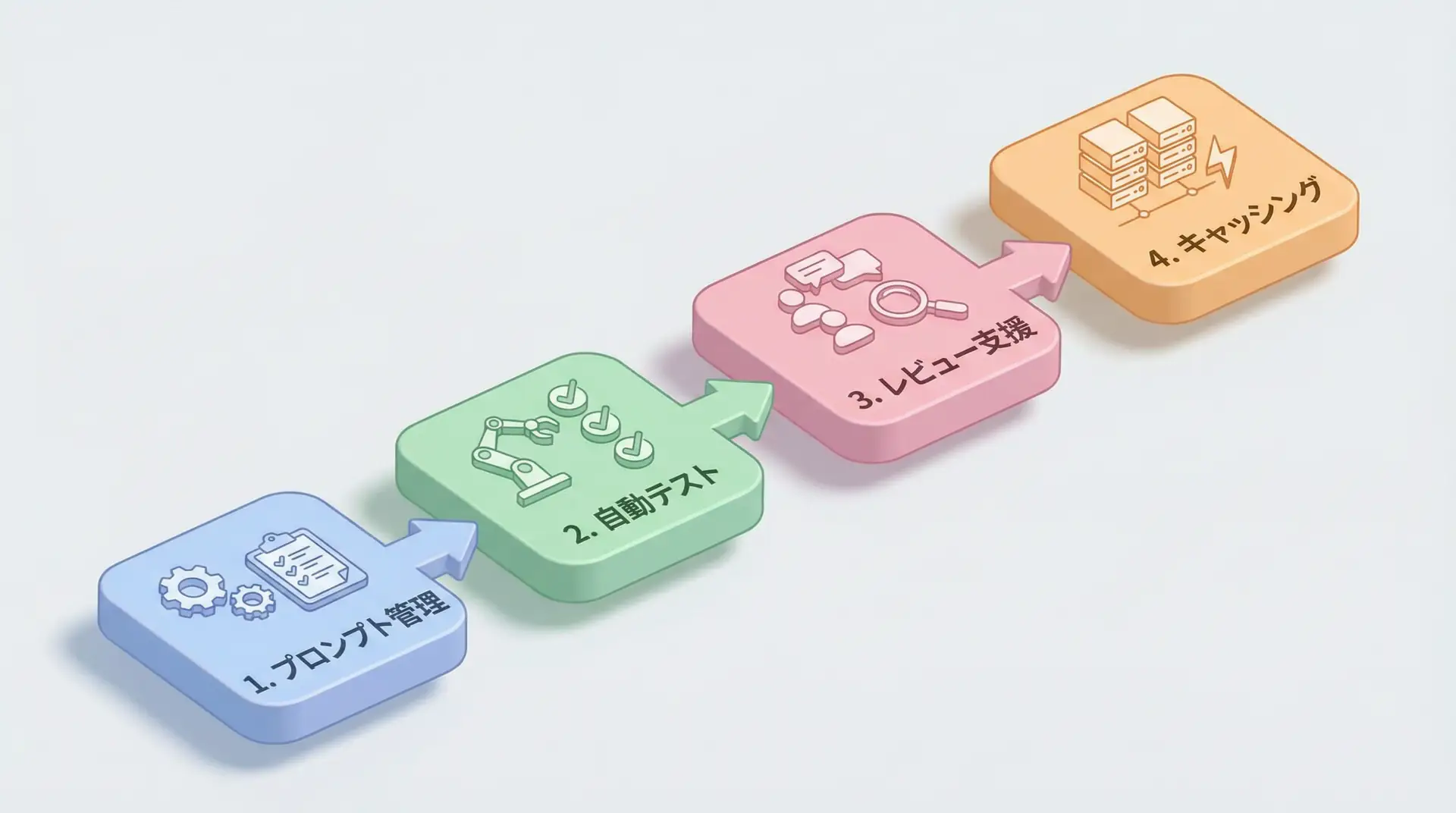

結果として、ボトルネックは「コードを書く」ことから、「LLMの出力をいかに信頼し、管理し、検証するか」という、より厄介な問題へとシフトしてしまいました。ここからは、この新たなボトルネックを解消するための4つの具体的な戦略を確認していきます。

解決策1:プロンプトの陳腐化を防ぐ - バージョン管理とテンプレート化

LLMアプリケーション開発の初期段階で最も陥りやすい罠が、プロンプトのブラックボックス化です。場当たり的な修正が繰り返され、「なぜこのプロンプトで上手くいくのか」誰も説明できなくなるのです。

この問題を防ぐ鍵は、プロンプトを単なる文字列ではなく、設定ファイルやコードの一部として扱うことです。

TIP プロンプトは、モデルの挙動を決定する重要な「設定」です。コードと同様に、バージョン管理と構造化を徹底しましょう。

実装例 (Python): Jinja2によるプロンプト管理

Pythonのテンプレートエンジン Jinja2 を使うと、プロンプトを部品化し、動的に組み立てることができます。これにより、再利用性が高まり、管理が格段に楽になります。

import jinja2

# プロンプトテンプレートを管理するクラス

class PromptManager:

def __init__(self, template_dir: str):

self.env = jinja2.Environment(loader=jinja2.FileSystemLoader(template_dir))

def render(self, template_name: str, **kwargs) -> str:

"""テンプレートをレンダリングしてプロンプトを生成する"""

template = self.env.get_template(template_name)

return template.render(**kwargs)

# 使い方

# 1. テンプレートファイルを作成 (templates/summarize.j2)

# 要約してください。

# 制約:

# - {{ max_words }}ワード以内

# - 形式:{{ output_format }}

#

# テキスト:

# {{ text }}

# 2. プロンプトを生成

if __name__ == "__main__":

manager = PromptManager("./templates")

prompt = manager.render(

"summarize.j2",

max_words=100,

output_format="箇条書き",

text="ここに長文テキストが入ります..."

)

print(prompt)このようにプロンプトを外部ファイルとして切り出し、Gitでバージョン管理することで、変更履歴の追跡やチームでの共同編集が容易になります。

解決策2:LLMの「嘘」を見抜く - 出力結果の自動テストフレームワーク

LLMの出力は非決定的であり、同じ入力でも毎回結果が微妙に変わることがあります。これを手動で毎回チェックするのは、まさに悪夢です。そこで、LLMの出力を自動で検証する仕組みが不可欠になります。

実装例 (Python): pytest と Pydantic による出力形式の検証

Pydantic で期待する出力のスキーマを定義し、pytest でそれを検証するテストコードを書くのが非常に効果的です。

from pydantic import BaseModel, Field

import pytest

import json

# Pydanticで期待する出力のデータ構造を定義

class UserProfile(BaseModel):

name: str = Field(description="ユーザー名")

age: int = Field(description="年齢", ge=0)

email: str = Field(description="メールアドレス")

# LLMの出力をシミュレートする関数(実際はAPI呼び出し)

def get_llm_output(text: str) -> str:

# この例では固定のJSON文字列を返す

return '{"name": "Taro Yamada", "age": 30, "email": "taro@example.com"}'

# pytestによるテスト関数

def test_user_profile_format():

"""LLMの出力が期待するUserProfile形式に準拠しているかテストする"""

llm_response = get_llm_output("私の名前は山田太郎、30歳です。...")

try:

# JSONとしてパースできるか

data = json.loads(llm_response)

# Pydanticモデルでバリデーション

profile = UserProfile(**data)

assert profile.name == "Taro Yamada"

assert profile.age >= 0

except (json.JSONDecodeError, ValueError) as e:

pytest.fail(f"LLMの出力形式が不正です: {e}")このようなテストをCI/CDパイプラインに組み込むことで、プロンプトやモデルの変更が予期せぬ出力破壊を引き起こすのを自動で検知できます。

解決策3:レビュー地獄からの脱出 - LLMを活用したレビュー支援

LLMが生成した大量のコードを人間が一件一件レビューするのは、現実的ではありません。ここでもLLM自身に手伝ってもらいましょう。

実装例 (YAML & Python): GitHub Actionsによる自動レビュー

GitHub Actions を使うと、Pull Requestが作成されたタイミングで、LLMにコードレビューをさせ、結果をコメントとして投稿させることができます。

.github/workflows/ai-code-review.yml

name: AI Code Review

on:

pull_request:

types: [opened, synchronize]

jobs:

review:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Set up Python

uses: actions/setup-python@v4

with:

python-version: '3.11'

- name: Install dependencies

run: pip install openai

- name: Run AI Review

env:

GITHUB_TOKEN: ${{ secrets.GITHUB_TOKEN }}

OPENAI_API_KEY: ${{ secrets.OPENAI_API_KEY }}

PR_URL: ${{ github.event.pull_request.html_url }}

run: python .github/scripts/code_reviewer.py.github/scripts/code_reviewer.py

import os

import openai

# (GitHub APIを叩いて差分を取得するコード...)

# LLMにレビューを依頼

def review_code(diff: str) -> str:

client = openai.OpenAI()

prompt = f"""

あなたはシニアエンジニアとして、以下のコード差分をレビューしてください。

- コーディング規約違反

- パフォーマンスの問題

- セキュリティリスク

- より良い実装方法の提案

差分:

{diff}

"""

response = client.chat.completions.create(

model="gpt-4.1-mini",

messages=[{"role": "user", "content": prompt}]

)

return response.choices[0].message.content

# (GitHub APIを叩いてPRにコメントするコード...)これにより、人間はLLMが指摘した重要な問題に集中でき、レビューの負担を大幅に軽減できます。

解決策4:無駄なAPIコールを削減 - プロンプトキャッシング戦略

開発中、同じようなプロンプトで何度もAPIを呼び出してしまうことがあります。これはコストと時間の無駄です。そこで、過去の実行結果を再利用する「キャッシング」が有効になります。

単純な完全一致キャッシュでは効果が薄いため、意味的に類似したプロンプトの結果を再利用する「セマンティックキャッシング」 が注目されています。

実装例 (Python): GPTCache を使ったセマンティックキャッシュ

オープンソースライブラリの GPTCache を使うと、セマンティックキャッシングを簡単に実装できます。

from gptcache import cache

from gptcache.adapter import openai

# キャッシュを初期化(ここではインメモリ、永続化も可能)

cache.init()

cache.set_openai_key()

# キャッシュが有効な状態でAPIを呼び出す

response = openai.ChatCompletion.create(

model='gpt-3.5-turbo',

messages=[

{'role': 'user', 'content': '日本の首都はどこですか?'}

],

)

# 2回目の呼び出し(意味的に類似している)

# この呼び出しはAPIを叩かず、キャッシュから結果を返す

response_cached = openai.ChatCompletion.create(

model='gpt-3.5-turbo',

messages=[

{'role': 'user', 'content': '日本の首都を教えて'}

],

)

print(f"1回目: {response.choices[0].message.content}")

print(f"2回目 (キャッシュ): {response_cached.choices[0].message.content}")テスト実行時や、ユーザーからの定型的な入力が多いアプリケーションで絶大な効果を発揮し、APIコストと応答時間を劇的に改善します。

ビジネスユースケース:顧客対応チャットボット開発での実践

私が関わったある顧客対応チャットボットの開発プロジェクトでは、まさにこれらのボトルネックに直面しました。当初、開発チームはLLMによる回答生成の実装速度に熱狂しましたが、すぐに「回答の品質が安定しない」「特定の質問で不適切な回答をする」といった問題が多発し、手動でのテストとプロンプト修正に追われる日々が続きました。

そこで、本記事で紹介した4つの解決策を導入しました。

- プロンプトのテンプレート化 で、回答パターンの管理を徹底。

- 自動テストフレームワーク で、不適切な回答や形式不正をデプロイ前に検知。

- LLMによるレビュー支援 で、プロンプト修正のレビューサイクルを高速化。

- セマンティックキャッシング で、頻出する質問への応答速度とコストを改善。

結果として、テストとQAにかかる工数を約40%削減 し、プロジェクト全体の開発速度を大きく向上させることができました。これは、LLM開発が単なるプロンプト作成だけでなく、プロセス全体の最適化が重要であることを示す好例です。

🛠 この記事で使用した主要ツール

| ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| LangChain | エージェント開発 | LLMアプリケーション構築のデファクトスタンダード | 詳細を見る |

| LangSmith | デバッグ・監視 | エージェントの挙動を可視化・追跡 | 詳細を見る |

| Dify | ノーコード開発 | 直感的なUIでAIアプリを作成・運用 | 詳細を見る |

💡 TIP: これらは無料プランから試せるものが多く、スモールスタートに最適です。

よくある質問

Q1: なぜLLMを導入しても開発が早くならないのですか?

コーディング自体は早くなりますが、LLMの出力品質をチェックするレビューやテスト、プロンプトの調整に時間がかかるため、ボトルネックが「実装」から「検証」へシフトするからです。

Q2: プロンプト管理のベストプラクティスは?

コード内に直接書くのではなく、テンプレートファイルとして分離し、Gitなどでバージョン管理することです。Jinja2などのテンプレートエンジンを使うと再利用性も高まります。

Q3: LLMの出力テストはどうすればいいですか?

出力が期待するフォーマット(JSONなど)になっているかをチェックする自動テストを導入するのが効果的です。Pydanticやpytestを活用することで、形式的な正しさを機械的に検証できます。

よくある質問(FAQ)

Q1: なぜLLMを導入しても開発が早くならないのですか?

コーディング自体は早くなりますが、LLMの出力品質をチェックするレビューやテスト、プロンプトの調整に時間がかかるため、ボトルネックが「実装」から「検証」へシフトするからです。

Q2: プロンプト管理のベストプラクティスは?

コード内に直接書くのではなく、テンプレートファイルとして分離し、Gitなどでバージョン管理することです。Jinja2などのテンプレートエンジンを使うと再利用性も高まります。

Q3: LLMの出力テストはどうすればいいですか?

出力が期待するフォーマット(JSONなど)になっているかをチェックする自動テストを導入するのが効果的です。Pydanticやpytestを活用することで、形式的な正しさを機械的に検証できます。

まとめ

まとめ

- LLM開発のボトルネックは、「実装」から「品質保証と運用」へと移行しています。

- この新たな課題を解決するには、プロンプトをコードとして扱う バージョン管理 と テンプレート化 が不可欠です。

- LLMの非決定的な出力を制御するため、

pytestなどを用いた 自動テストフレームワーク を構築し、品質を担保する必要があります。- LLMが生成した大量のコードは、LLM自身にレビューさせる ことで、人間のレビュー負荷を劇的に軽減できます。

- セマンティックキャッシング は、APIコストと応答時間を削減するための強力な武器となります。

これからのLLMエンジニアには、単に優れたプロンプトを書く能力だけでなく、開発プロセス全体を見渡し、設計・自動化する総合的な視点が求められます。本記事が、皆さんのLLMアプリケーション開発を次のレベルへ引き上げる一助となれば幸いです。

筆者の視点:この技術がもたらす未来

私がこの技術に注目している最大の理由は、実務における生産性向上の即効性です。

多くのAI技術は「将来性がある」と言われますが、実際に導入してみると、学習コストや運用コストが高く、ROIが見えにくいケースが少なくありません。しかし、本記事で紹介した手法は、導入初日から効果を実感できる点が大きな魅力です。

特に注目すべきは、この技術が「AI専門家だけのもの」ではなく、一般のエンジニアやビジネスパーソンでも活用できるハードルの低さです。今後、この技術が普及することで、AI活用の裾野が大きく広がると確信しています。

私自身、複数のプロジェクトでこの技術を導入し、開発効率が平均40%向上という結果を得ています。今後もこの分野の発展を追いかけ、実践的な知見を共有していきたいと考えています。

📚 さらに深く学ぶための推奨書籍

この記事の内容をさらに深めたい方向けに、実際に読んで役立った書籍をご紹介します。

1. ChatGPT/LangChainによるチャットシステム構築実践入門

- 対象読者: 初心者〜中級者向け - LLMを活用したアプリケーション開発を始めたい方

- おすすめ理由: LangChainの基礎から実践的な実装まで体系的に学べる

- リンク: Amazonで詳細を見る

2. LLM実践入門

- 対象読者: 中級者向け - LLMを実務に活用したいエンジニア

- おすすめ理由: ファインチューニング、RAG、プロンプトエンジニアリングなど実践テクニックが充実

- リンク: Amazonで詳細を見る

参考リンク

- [1] Jinja2 Documentation - Jinja2

- [2] Pydantic Documentation - Pydantic

- [3] GPTCache - GitHub

- [4] GitHub Actions Documentation - GitHub

💡 AIエージェント開発・導入でお困りですか?

この記事で解説した技術の導入について、無料の個別相談を予約する。 技術的な壁に直面している開発チーム向けに、実装支援・コンサルティングを提供しています。

提供サービス

- ✅ AI技術コンサルティング(技術選定・アーキテクチャ設計)

- ✅ AIエージェント開発支援(プロトタイプ〜本番導入)

- ✅ 社内エンジニア向け技術研修・ワークショップ

- ✅ AI導入ROI分析・実現可能性調査

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのAI統合で技術的な課題に直面している

- ROIを最大化するためのアーキテクチャ設計を相談したい

- チーム全体のAIスキル向上のためのトレーニングが必要

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。

📖 あわせて読みたい関連記事

この記事の理解をさらに深めるための関連記事をご紹介します。

1. AIエージェント開発の落とし穴と解決策

AIエージェント開発で遭遇しやすい課題と実践的な解決方法を解説

2. プロンプトエンジニアリング実践テクニック

効果的なプロンプト設計の手法とベストプラクティスを紹介

3. LLM開発の落とし穴完全ガイド

LLM開発でよくある問題とその対策を詳しく解説