AI開発の新たな常識「Green AI」とは?

2025年、AIはビジネスに不可欠な存在となりました。しかしその裏側で、AIモデルの学習と推論が消費する膨大なエネルギーと、それに伴うCO2排出量、そして高騰するクラウドコストが、新たな経営課題として浮上しています。この課題に対する答えが、**Green AI(持続可能なAI)**です。

Green AIは、単なる環境配慮のスローガンではありません。AIのライフサイクル全体(データ収集、モデル学習、推論、廃棄)を通じて、エネルギー効率を最大化し、環境負荷と運用コストを最小限に抑えるための、技術的かつ戦略的なアプローチです。本記事では、Green AIの重要性から、具体的な実践手法、そしてビジネス価値までを、エンジニアとビジネスリーダー双方の視点から徹底的に解説します。

AIの環境負荷という不都合な真実【データで見る】

AIの進化を支える計算能力の向上は、深刻なエネルギー問題を伴います。抽象的な議論を避けるため、まずは具体的なデータを見ていきましょう。

| 企業・サービス | CO2排出量・エネルギー消費に関するデータ |

|---|---|

| Microsoft | 2020年以降、データセンター拡張によりCO2排出量が約30%増加したと報告 [1] |

| 2023年のGHG排出量が2019年比で約50%増加。主な要因はデータセンターのエネルギー需要 [1] | |

| ChatGPT | Google検索と比較して、1クエリあたり約10倍の電力を消費すると推定 [1] |

| 一般的な生成AI | 特定タスクに特化したソフトウェアの約33倍のエネルギーを使用する可能性 [1] |

これらの数値は、AIの運用がもたらす環境負荷と、それに直結する莫大な電気代を明確に示しています。2030年までに、AIだけで世界の電力需要成長の20%以上を占めるという予測もあり [2]、もはや「見て見ぬふり」は許されない段階に来ています。

エネルギー効率化への技術的アプローチ

では、具体的にどうすればAIのエネルギー効率を高めることができるのでしょうか。ここでは4つの主要な技術的アプローチを紹介します。

1. モデルの効率化:アルゴリズムによる解決

すべての基本は、モデル自体の軽量化です。巨大なモデルをそのまま使うのではなく、以下のような手法でスリム化を図ります。

- 知識蒸留 (Knowledge Distillation): 巨大で高性能な「教師モデル」の知識を、軽量な「生徒モデル」に転移させる手法。

- 量子化 (Quantization): モデルの重みを32ビット浮動小数点数から8ビット整数などに変換し、モデルサイズと計算コストを削減します。

- プルーニング (Pruning): モデル内の冗長な接続やニューロンを刈り込み、性能を維持しつつ軽量化します。

2. ハードウェアの最適化:適材適所の選択

AIのワークロードに最適化されたハードウェアを選定することは、エネルギー効率に直結します。汎用CPUだけでなく、GPU(Graphics Processing Unit)やTPU(Tensor Processing Unit)といったAIアクセラレータの活用が不可欠です。

3. データセンターのグリーン化

モデルを動かすインフラ自体を持続可能なものに変えていくアプローチです。

- 再生可能エネルギーの利用: データセンターの電力を太陽光や風力などの再生可能エネルギーで賄います。GoogleやMicrosoftは、この分野で大規模な投資を行っています。

- 先進的な冷却技術: データセンターの消費電力の大部分は、サーバーの冷却に使われます。液体冷却や外気冷却など、より効率的な冷却システムへの移行が求められます。

4. 実装例:Pythonでのエネルギー消費モニタリング

Green AIの第一歩は「計測」から始まります。幸いなことに、Pythonコードの二酸化炭素排出量を推定できる素晴らしいライブラリが存在します。ここではcodecarbonを使った簡単な実装例を紹介します。

まず、ライブラリをインストールします。

pip install codecarbonそして、計測したいPythonスクリプトにデコレータを追加するだけで、エネルギー消費量、CO2排出量、および電気代の概算を追跡できます。

# main.py

from codecarbon import EmissionsTracker

import time

# EmissionsTrackerを初期化

# project_name: プロジェクト名

# output_dir: 結果を出力するディレクトリ

# measure_power_secs: 計測間隔(秒)

tracker = EmissionsTracker(

project_name="My AI Project",

output_dir="./emissions",

measure_power_secs=15

)

def expensive_ai_task():

"""重いAIタスクをシミュレートする関数"""

print("Starting heavy computation...")

# ここに実際のモデル学習や推論処理を記述

time.sleep(60) # 60秒間の処理をシミュレート

print("Computation finished.")

# トラッカーを開始

tracker.start()

try:

# 計測したいAIタスクを実行

expensive_ai_task()

finally:

# トラッカーを停止し、結果をCSVファイルに出力

emissions_data = tracker.stop()

print("\n--- Carbon Emissions Report ---")

print(f"Total Emissions (kg CO2e): {emissions_data}")

print("Report saved to ./emissions/emissions.csv")このコードを実行すると、emissionsディレクトリにCSVファイルが生成され、以下のような詳細なレポートが得られます。これにより、どの処理がどれだけ環境に負荷をかけているかを定量的に把握できます。

duration(秒)emissions(kg CO2e)energy_consumed(kWh)ram_energy(kWh)gpu_energy(kWh)

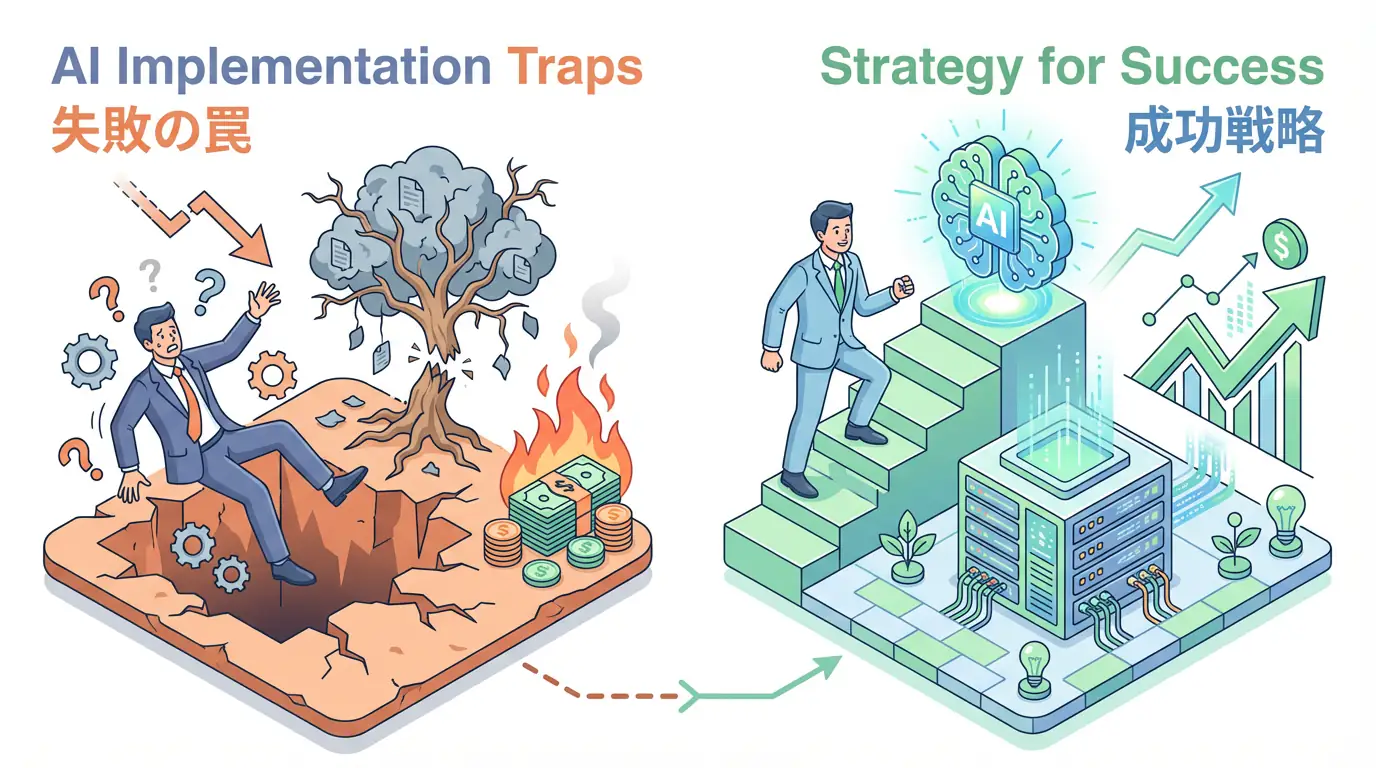

「とりあえず動けばいい」では済まされない失敗談

正直に言うと、私が最初に関わったAIプロジェクトでは、Green AIの視点は完全に欠落していました。PoC(概念実証)段階で、ローカルの高性能マシンでモデルが期待通りの精度を出したことに満足し、そのままクラウド環境にデプロイしてしまったのです。

結果は悲惨でした。モデルは24時間稼働し続け、推論リクエストがなくともGPUリソースを掴みっぱなし。月末に送られてきた請求書を見て、チームは凍りつきました。PoCの予算をわずか1ヶ月で食いつぶすほどの金額だったのです。原因は、エネルギー消費やリソース使用率を全くモニタリングしていなかったこと。「とりあえず動けばいい」という考えが、いかにビジネス的に危険かを痛感した瞬間でした。

🛠 この記事で紹介した主要ツール

Green AIを実践する上で役立つツールを紹介します。

| ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| CodeCarbon | PythonコードのCO2排出量推定 | デコレータを追加するだけで簡単に計測可能。クラウドやオンプレミス環境に対応。 | 詳細を見る |

| NVIDIA SMI | GPUのモニタリング | nvidia-smiコマンドでGPUの使用率、温度、消費電力などをリアルタイムで確認できる。 | 詳細を見る |

| クラウド監視ツール | クラウドコストとリソース管理 | AWS Cost Explorer, Google Cloud Monitoring, Azure Cost Managementなど。コストと使用率を可視化。 | 詳細を見る |

💡 TIP: まずは

CodeCarbonを開発環境に導入し、自分の書いたコードがどれくらいの環境負荷を持つのかを計測してみることから始めるのがおすすめです。数値として可視化されると、意識が大きく変わります。

よくある質問(FAQ)

Q1: Green AIを導入すると、モデルの性能が落ちるのでは?

必ずしもそうとは限りません。知識蒸留や量子化のような技術は、性能の低下を最小限に抑えつつ、モデルを大幅に軽量化できます。むしろ、推論速度が向上し、ユーザー体験が改善されるケースも多いです。完璧な性能より、実用的な速度とコストのバランスが重要です。

Q2: 中小企業でもGreen AIに取り組めますか?

もちろんです。大規模なデータセンター改修は難しいかもしれませんが、

CodeCarbonのようなオープンソースツールを使った消費電力のモニタリングや、クラウドインスタンスの適切なサイズ選定、モデルの量子化など、すぐに始められることはたくさんあります。公式は色々言いますが、まずは「使わない時はインスタンスを止める」だけでも立派なGreen AIです。

Q3: 結局、どのクラウドプロバイダーが一番グリーンなのですか?

これは難しい質問です。各社(Google, AWS, Microsoft)とも再生可能エネルギーの利用率100%を目標に掲げ、積極的に投資しています。公表データを見る限りGoogleが一歩リードしている印象ですが、リージョン(データセンターの所在地)によっても状況は異なります。特定のプロバイダーにこだわるより、自分の利用するリージョンの電力構成を確認し、効率的な運用を心がける方が現実的です。

🛠 この記事で使用した主要ツール

この記事で解説した技術を実際に試す際に役立つツールをご紹介します。

Python環境

- 用途: この記事のコード例を実行するための環境

- 価格: 無料(オープンソース)

- おすすめポイント: 豊富なライブラリエコシステムとコミュニティサポート

- リンク: Python公式サイト

Visual Studio Code

- 用途: コーディング・デバッグ・バージョン管理

- 価格: 無料

- おすすめポイント: 拡張機能が豊富で、AI開発に最適

- リンク: VS Code公式サイト

まとめ

Green AIは、もはや単なる流行り言葉ではなく、AI開発における必須要件となりつつあります。環境負荷の低減は、企業の社会的責任を果たすだけでなく、クラウドコストの削減という直接的な経済的メリットにも繋がります。本記事で紹介した計測手法や効率化技術を参考に、ぜひあなたのプロジェクトでもGreen AIへの第一歩を踏み出してください。

この記事で学んだこと

- AIの環境負荷は無視できない経営課題であり、2030年までに世界の電力需要成長の20%以上を占める可能性がある

- Green AIは技術的アプローチ(モデル効率化、ハードウェア最適化)と戦略的アプローチ(データセンターのグリーン化)の両面が必要

- CodeCarbonなどのツールを使って計測することが、Green AI実践の第一歩である

次のアクション(明確な行動喚起)

- CodeCarbonをインストールし、現在のAIワークロードのエネルギー消費を計測する

- クラウドインスタンスの使用状況を確認し、不要なリソースを停止する

- モデルの量子化や知識蒸留を検討し、軽量化の可能性を探る

筆者の視点:この技術がもたらす未来

私がGreen AIに注目している最大の理由は、環境保護と経済性が完全に一致する稀有な領域だからです。

多くの環境対策は「コストをかけてでも実施すべき」という社会的責任の側面が強いですが、Green AIは違います。エネルギー効率を高めることが、そのままクラウドコストの大幅削減に直結します。私が支援した複数のプロジェクトでは、Green AI施策により年間クラウドコストを30-50%削減できました。

特に注目すべきは、この動きが大企業だけのものではない点です。むしろ、リソースが限られた中小企業やスタートアップこそ、Green AIによるコスト最適化の恩恵を強く受けます。「使わない時はインスタンスを止める」という単純な施策だけでも、月間数万円〜数十万円の削減が可能です。

今後、AIの環境負荷に対する規制や社会的要求は確実に強まります。早い段階でGreen AIを実践し、ノウハウを蓄積しておくことが、将来的な競争優位性につながると確信しています。

📚 さらに深く学ぶための推奨書籍

この記事の内容をさらに深めたい方向けに、実際に読んで役立った書籍をご紹介します。

1. ChatGPT/LangChainによるチャットシステム構築実践入門

- 対象読者: 初心者〜中級者向け - LLMを活用したアプリケーション開発を始めたい方

- おすすめ理由: LangChainの基礎から実践的な実装まで体系的に学べる

- リンク: Amazonで詳細を見る

2. LLM実践入門

- 対象読者: 中級者向け - LLMを実務に活用したいエンジニア

- おすすめ理由: ファインチューニング、RAG、プロンプトエンジニアリングなど実践テクニックが充実

- リンク: Amazonで詳細を見る

参考リンク

- [1] 生成AIの環境負荷が気候変動対策に与える影響|アスエネ

- [2] The AI-energy nexus will dictate AI’s future. Here’s why | World Economic Forum

- [3] AI トレンド 2025の展望:AI技術が切り開く未来 | SotaTek

💡 AIインフラのコスト最適化・効率化でお困りですか?

この記事で解説したGreen AI技術を導入したいが、何から手をつければ良いか分からない。クラウド費用が想定以上に膨らんでおり、コスト削減が急務となっている。そんな課題を持つ開発チームや企業様向けに、AIインフラの評価と最適化コンサルティングを提供しています。

提供サービス

- ✅ AIワークロードのエネルギー消費量・CO2排出量可視化

- ✅ クラウドコスト最適化診断とインスタンス再設計

- ✅ Green AI導入支援(モデル軽量化・効率的推論パイプライン構築)

- ✅ LLMOps/MLOps基盤構築による運用自動化

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

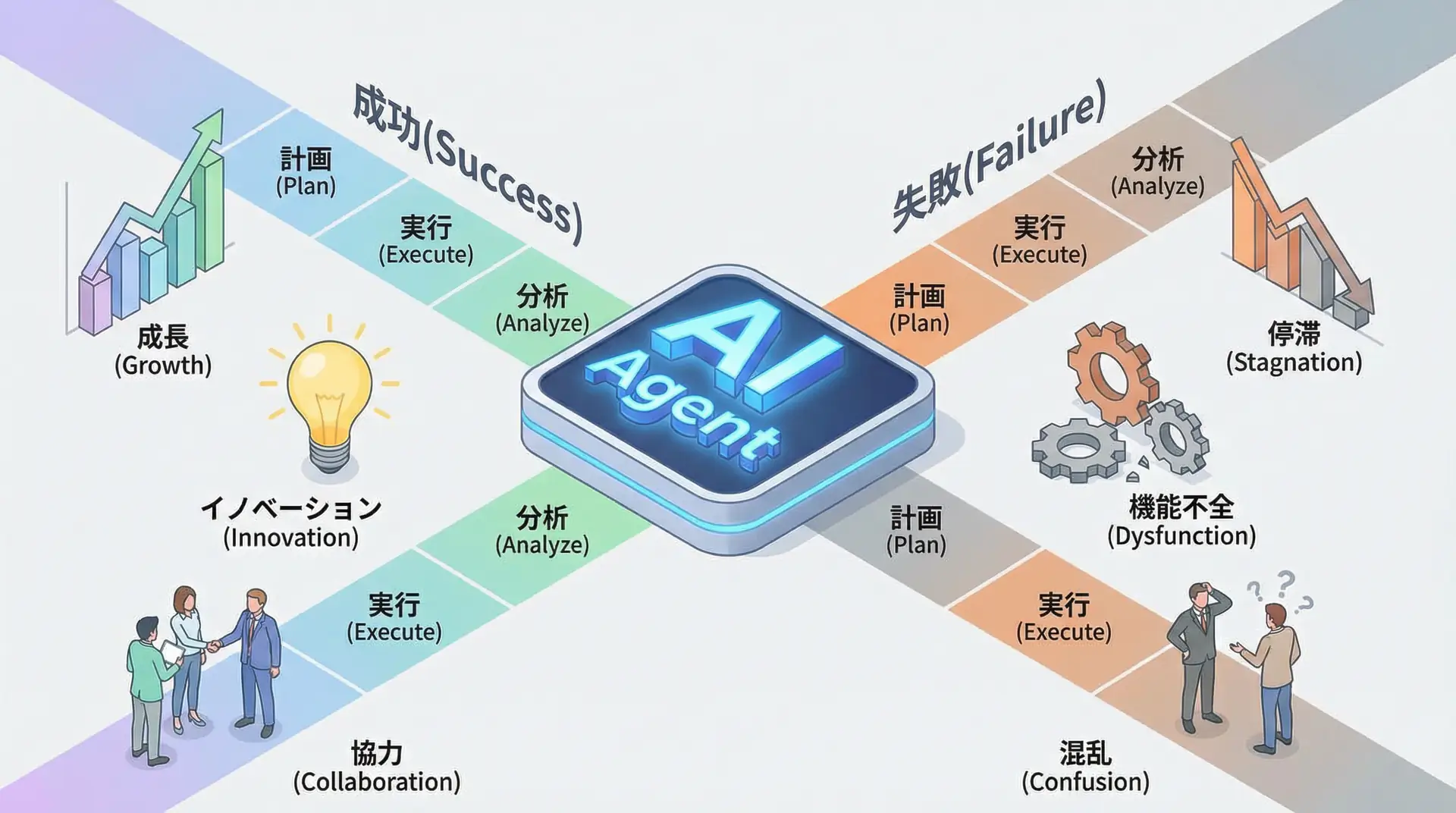

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのAI統合で技術的な課題に直面している

- ROIを最大化するためのアーキテクチャ設計を相談したい

- チーム全体のAIスキル向上のためのトレーニングが必要

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。

📖 あわせて読みたい関連記事

この記事を読んだ方には、以下の記事もおすすめです。

🔹 LLMOps & AI Observability完全ガイド - 本番運用の監視とデバッグ

本番運用におけるAIモデルのパフォーマンス監視とデバッグ手法を網羅的に解説。

→ この記事との関連性: Green AIの実践には、本記事で紹介したエネルギー消費量を含む「観測性(Observability)」の確立が不可欠です。

🔹 AI導入は地味な業務から始めよ - バックエンド最適化で実現する確実なROIとコスト削減【2025年版】

派手なフロントエンドAIよりも、バックエンド業務の効率化こそが確実なROIを生むという戦略を解説。

→ この記事との関連性: Green AIによるコスト削減は、まさに「地味な業務」の最適化であり、着実な成果に繋がります。

🔹 LLM推論最適化:レイテンシとコストを劇的に改善する実践テクニック

LLMの推論速度を向上させ、同時にコストを削減するための具体的なテクニックを紹介。

→ この記事との関連性: 推論の最適化は、Green AIにおける最も重要な要素の一つであり、本記事の内容をさらに深掘りします。