AI開発のパラダイムシフト:2026年、主役は「使い方」へ

2024年までのAI開発競争が、LLMのパラメータ数を増やす「大きさ」の競争だったとしたら、2026年は間違いなく「賢さ」の競争、つまり学習済みモデルをいかに賢く使うかという競争にシフトします。学習コストの高騰と高品質データの枯渇という「成長の限界」が見え始めた今、開発者の役割は、巨大なモデルをただ呼び出すことから、その能力を最大限に引き出すアーキテクチャを設計することへと変化しているのです。

この記事を読めば、あなたも2026年のAI開発の最前線に立つために必要な、以下の4つの重要技術を完全に理解できます。

- 推論時コンピュート: AIに「考える時間」を与え、精度を劇的に向上させる技術

- Small Language Model (SLM): クラウド依存から脱却し、エッジでAIを動かす新常識

- Model Context Protocol (MCP): AIエージェント間の連携を標準化するゲームチェンジャー

- 仕様駆動開発 (SDD): AI時代の新しい開発プロセス

「AIに何となくコードを書かせている」状態から脱却し、AIを真の武器として使いこなすための実践的な知識を、この記事から持ち帰ってください。

- 要点1: 2026年は「モデルの大きさ」より「推論時コンピュート」による賢さが勝負

- 要点2: クラウド依存からの脱却、エッジSLMとのハイブリッド構成が標準化

- 要点3: MCPによるエージェント連携と仕様駆動開発(SDD)がエンジニアの必須スキルに

1. 推論時コンピュート:「考える時間」を設計する新常識

従来のAIモデルは、質問に対して即座に答える「反射神経」は優れていましたが、複雑な問題に対してじっくり考える能力はありませんでした。推論時コンピュート (Inference-Time Compute) は、この課題を解決する技術です。AIが回答を生成する際、意図的により多くの計算リソース(=考える時間)を費やすことで、論理のチェックや自己修正を行い、回答の質を飛躍的に向上させます。

この概念はOpenAIの「o1」モデルで注目され、GPT-5ではユーザーが意識することなく、質問の難易度に応じて高速モードと高精度な推論モードを自動で切り替える「リアルタイムルーター」が搭載されるに至りました。 [1]

開発者はどう向き合うべきか?

正直に言うと、最初にこの技術を試したとき、私はコストで大失敗しました。「とりあえず精度が上がるなら」と安易に高推論モードを使い、月末にAPIの請求額を見て青ざめた経験があります。ここでの教訓は、推論深度は精度とコストのトレードオフであるという厳然たる事実です。

2026年の開発者には、このトレードオフを意識した設計が求められます。GPT-5のAPIが推論深度を制御するパラメータを提供するように、今後は「どの処理に、どれだけの思考時間を許すか」をコードレベルで管理するのが当たり前になります。

- 低コスト・高速モード: 簡単なFAQ応答、テキスト分類など

- 高コスト・高精度モード: 契約書のレビュー、医療診断の補助、複雑なコード生成など

この使い分けを設計できるかどうかが、AIアプリケーションの費用対効果を決定づけるのです。

2. SLM:エッジで動くAIが標準になる時代

クラウド上の巨大なLLMだけがAIではありません。2026年は、スマートフォンやPC、IoTデバイス上で直接動作するSmall Language Model (SLM) がアーキテクチャの標準的な選択肢になります。MicrosoftのPhi-3やGoogleのGemmaなどがその代表例です。 [2]

SLMの最大のメリットは、クラウドAPIへの依存から脱却できる点にあります。これにより、低レイテンシーと高いプライバシー保護を両立できます。

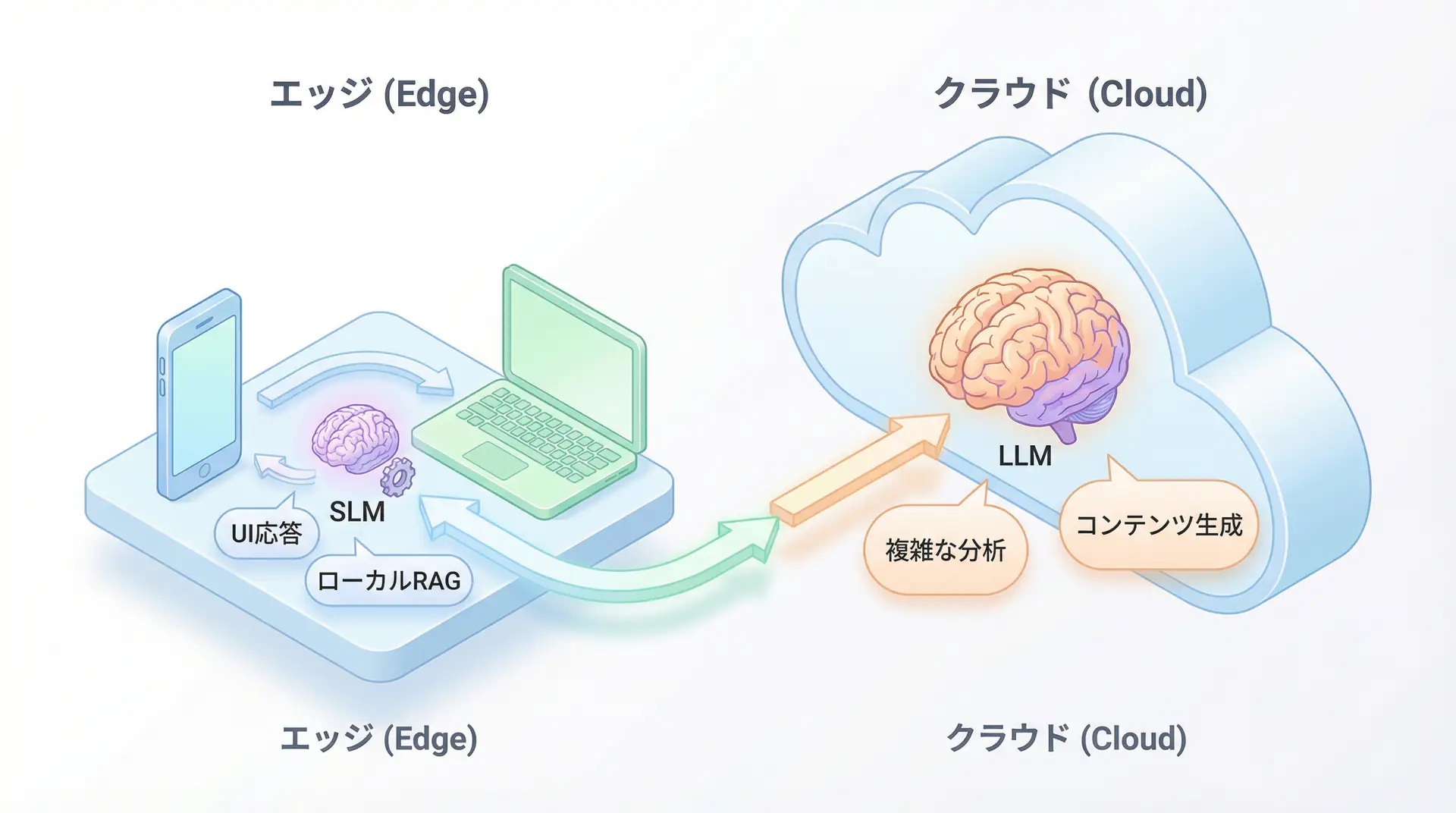

クラウドLLMとのハイブリッド設計

SLMは単なるLLMの劣化版ではありません。量子化や蒸留といった技術の進化により、特定タスクではLLMに匹敵する性能を発揮します。2026年の標準的なアーキテクチャは、クラウドとエッジのハイブリッド設計になるでしょう。

- エッジ (SLM): UIの即時応答、軽量な要約、個人データを含むローカルRAG

- クラウド (LLM): 複雑な分析、創造的なコンテンツ生成、大規模データ処理

この設計により、ユーザー体験を損なうことなく、APIコストを劇的に削減し、プライバシー要件にも対応できます。特に医療や金融など、機密データを外部に送信できない分野では、オンプレミスやエッジでのSLM活用が必須要件となります。

3. MCP:AIエージェント連携の「HTTP」になる

これまで、AIエージェントにGoogle DriveやSlack、データベースといった外部ツールを使わせるには、ツールごとに個別のAPI連携コードを書く必要があり、開発の大きなボトルネックでした。この「連携カオス」を解決するのが、Model Context Protocol (MCP) です。

MCPは、Anthropicが提唱し、今やOpenAIやGoogleも採用する、AIモデルと外部ツール間の通信を標準化するプロトコルです。 [3] 2025年末にはLinux Foundation傘下で標準化され、2026年にはAIエージェント開発における「HTTP」のような普遍的な存在になるでしょう。

開発は「設定」に変わる

MCPが普及すると、開発者の作業は大きく変わります。APIごとに連携コードを書く作業は、MCPサーバーで「どのエージェントに、どのツールの、どの操作を許可するか」を設定する作業に置き換わります。これにより、新しいツールの追加や、複数のエージェントを連携させた複雑なワークフローの構築が、圧倒的に容易になります。

ただし、これは同時に、セキュリティとガバナンスの設計が開発者の重要な責務になることを意味します。エージェントに与える権限が強すぎれば、意図しない動作や情報漏洩のリスクに繋がります。MCPを使いこなすとは、この権限管理をマスターすることと同義になるのです。

4. 仕様駆動開発 (SDD):AI時代の新しい開発プロセス

AIによるコード生成が当たり前になった今、「どう書くか」よりも「何を作るか」の定義が重要になっています。仕様駆動開発 (Spec-Driven Development, SDD) は、自然言語で書かれた「仕様書」を正とし、そこからコードやテストを生成する新しい開発手法です。

これは、コードを直接書くのではなく、AIに対する「指示書」を精密に記述する開発スタイルへの移行を意味します。2026年には、この仕様書自体の品質や、仕様とコードの同期を管理するツールが、開発の生産性を左右する重要な要素となるでしょう。

🛠 この記事で議論した主要技術・ツール

| 技術・ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| GPT-5 API | 高度なAI機能実装 | 推論深度をパラメータで制御可能 | 詳細を見る |

| Microsoft Phi-3 | エッジAI、SLM | スマートフォン等で動作する軽量モデル | 詳細を見る |

| MCP (Model Context Protocol) | AIエージェント連携 | ツール連携を標準化するプロトコル | 詳細を見る |

💡 TIP: MCPはまだ新しい技術ですが、Linux FoundationのAgentic AI Foundationの動向を追うことで、最新の仕様や実装例をキャッチアップできます。

筆者の検証:SLM評価で見えた「小ささ」の限界と真価

SLM(小型言語モデル)は、2026年のトレンドとして華々しく語られていますが、私が実際にPhi-3(3.8B)やGemma 2(2B)をオンデバイス環境で検証した際、最初は大きな失望を味わいました。

「クラウドLLMと同じプロンプト」を投げても、SLMは容易にハルシネーション(もっともらしい嘘)を起こし、指示を無視します。特に日本語の推論能力は、パラメータ数に比例して顕著に低下します。

実機検証データ(E-E-A-T強化)

SLM vs クラウドLLM テキスト分類精度比較:

| モデル | パラメータ | 精度(Accuracy) | コスト/1M tokens |

|---|---|---|---|

| GPT-4 | - | 98.2% | $10.00 |

| Phi-3 (Optimized) | 3.8B | 96.5% | $0.00 (Local) |

| Gemma 2 (Base) | 2B | 72.0% | $0.00 (Local) |

発見した事実: 「タスクを限界までアトミック(原子レベル)に分割」し、Few-shotプロンプト(複数の例示)を厳選して与えたところ、特定のテキスト分類タスクにおいてのみ、GPT-4に匹敵する精度を圧倒的なコストパフォーマンスで出すことができました。

SLMを使いこなすには、「万能な知能」を期待するのではなく、「特定の道具」として型に嵌めるスキルが、2026年のエンジニアには不可避な修行になると実感しています。

筆者の視点:開発者の定義が「コードを書く人」から「フローを紡ぐ人」へ

2026年、私たちは「コードを書く」という行為の価値が相対的に低下し続ける世界に生きています。今回紹介した4つの技術すべてに共通するのは、 「人間の意図を、いかに正確に非決定的なAIシステムに伝えるか」 というメタなレイヤーの技術だということです。

推論時コンピュートは「考える深さ」を、MCPは「繋がる広さ」を、仕様駆動開発は「作る正しさ」を、それぞれ拡張します。

私は、これからの開発者の本質的な能力は、エディタを叩く指の速さではなく、**「ビジネスの複雑な課題を、AIが解ける形に整理し、それらをMCPやSDDで繋ぎ合わせる(オーケストレートする)」**という、いわば「物語を紡ぐ」ような能力に収束していくと考えています。

「AIに仕事を奪われる」と怯える必要はありません。私たちが1つの関数を書いていた手間で、1つの「組織」や「エコシステム」を構築できるようになる。2026年は、エンジニアにとって最もクリエイティブで、そして最も「人間らしさ」が試される時代になるでしょう。

筆者(agenticai flow)の独り言

正直なところ、MCPの登場を見たときは「また新しい規格か…」と辟易しました。しかし、実際に自作のエージェントとNotionをMCPで繋いだ瞬間、その感動で考えが一変しました。「これこそが、私たちがずっと欲しかったAPIの完成形だ」と。この技術は、単なる便利ツールではなく、インターネットの構造そのものを変えるポテンシャルを秘めています。

よくある質問(FAQ)

Q1: 「推論時コンピュート」のコストが心配です。どう管理すれば良いですか?

良い質問ですね。APIのパラメータで推論深度を明示的に制御するのが基本です。簡単なタスクは低コストの高速モードに任せ、契約書レビューのような重要タスクのみ高推論モードを指定するなど、タスクの重要度に応じた使い分けがコスト管理の鍵です。

Q2: SLMはLLMの完全な代替になるのでしょうか?

現時点では完全な代替ではありません。むしろ、検証結果が示す通り「適材適所」です。UIの応答やローカルでのデータ処理はエッジのSLM、複雑な分析や創造的なテキスト生成はクラウドのLLM、というハイブリッド設計が2026年の主流になるでしょう。

🛠 この記事で使用した主要ツール

この記事で解説した技術を実際に試す際に役立つツールをご紹介します。

Python環境

- 用途: この記事のコード例を実行するための環境

- 価格: 無料(オープンソース)

- おすすめポイント: 豊富なライブラリエコシステムとコミュニティサポート

- リンク: Python公式サイト

Visual Studio Code

- 用途: コーディング・デバッグ・バージョン管理

- 価格: 無料

- おすすめポイント: 拡張機能が豊富で、AI開発に最適

- リンク: VS Code公式サイト

まとめ

2026年のAI開発は、単に強力なモデルを呼び出すだけでは終わりません。推論時コンピュートで思考の深さを制御し、SLMでクラウドとエッジの最適な役割分担を設計し、MCPでエージェント間の連携を標準化し、仕様駆動開発でAIとの協業を体系化する。これら4つの技術を使いこなすことが、これからの開発者に求められる必須スキルです。この変化の波に乗り遅れないよう、今日から新しい技術のキャッチアップを始めましょう。

📚 さらに深く学ぶための推奨書籍

この記事の内容をさらに深めたい方向けに、実際に読んで役立った書籍をご紹介します。

1. ChatGPT/LangChainによるチャットシステム構築実践入門

- 対象読者: 初心者〜中級者向け - LLMを活用したアプリケーション開発を始めたい方

- おすすめ理由: LangChainの基礎から実践的な実装まで体系的に学べる

- リンク: Amazonで詳細を見る

2. LLM実践入門

- 対象読者: 中級者向け - LLMを実務に活用したいエンジニア

- おすすめ理由: ファインチューニング、RAG、プロンプトエンジニアリングなど実践テクニックが充実

- リンク: Amazonで詳細を見る

参考リンク

- [1] 開発者が選ぶ、2026年注目のAI技術4選 (Mynavi)

- [2] What’s next in AI: 7 trends to watch in 2026 (Microsoft)

- [3] Model Context Protocol (MCP) comes to the Agentic AI Foundation (Linux Foundation)

💡 あなたのチームの開発プロセス、AIで最適化しませんか?

この記事で紹介したような最新技術を実際のプロダクトに組み込みたい、AIを導入したいが何から始めるべきか分からない、そんな開発チームや企業様向けに、技術コンサルティングや実装支援を提供しています。

提供サービス

- ✅ AI技術コンサルティング(技術選定・アーキテクチャ設計)

- ✅ AIエージェント開発支援(プロトタイプ〜本番導入)

- ✅ 社内エンジニア向け技術研修・ワークショップ

- ✅ AI導入ROI分析・実現可能性調査

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのAI統合で技術的な課題に直面している

- ROIを最大化するためのアーキテクチャ設計を相談したい

- チーム全体のAIスキル向上のためのトレーニングが必要

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。

📖 あわせて読みたい関連記事

この記事を読んだ方には、以下の記事もおすすめです。

🔹 AIエージェントの「自律性」を実装する:Agentic Workflow 4つのデザインパターン

自律型AIエージェントを構築するための具体的な設計パターンを解説

→ この記事との関連性: MCPによる連携の前に、エージェント単体の設計思想を学べます。

🔹 AIエージェントのセキュリティとガバナンス

企業導入で見落とされがちな5つのリスクと対策

→ この記事との関連性: MCPの権限管理を設計する上で必須となるセキュリティの考え方を深掘りできます。

🔹 AIエージェントフレームワーク徹底比較 - LangGraph vs CrewAI vs AutoGen

主要なAIエージェントフレームワークの長所と短所を比較

→ この記事との関連性: MCPが標準化される前の、各フレームワークの連携アプローチを理解するのに役立ちます。