単一エージェントの限界と、分散処理による解決策

開発現場で LLM を活用し始めた当初、私は単一の AI エージェントにすべてを任せようとしていました。コード生成、レビュー、テスト作成までを一つのプロンプトで処理させる試みです。しかし、すぐに壁にぶつかりました。コンテキストウィンドウの制限、タスクの複雑化に伴うハルシネーションの増加、そして特定の領域における専門性の欠如です。

例えば、法務チェックが必要な契約書生成タスクを単一モデルに任せると、法律用語の誤用や論理の飛躍が発生しやすくなります。これはモデルの能力不足というより、 ** 注意力の分散 ** が原因です。人間組織が専門部署に分かれているのと同様に、AI システムも役割を分離すべきだと気づきました。

そこで注目したのが ** マルチエージェントアーキテクチャ ** です。これは単にエージェントを増やすことではなく、タスクを分解し、専門化されたエージェントが協調して処理する仕組みを指します。本稿では、私が実際のプロジェクトで採用し、安定動作を確認した Orchestrator パターンに基づく実装方法と、その設計思想を共有します。

なぜ今、マルチエージェントなのか

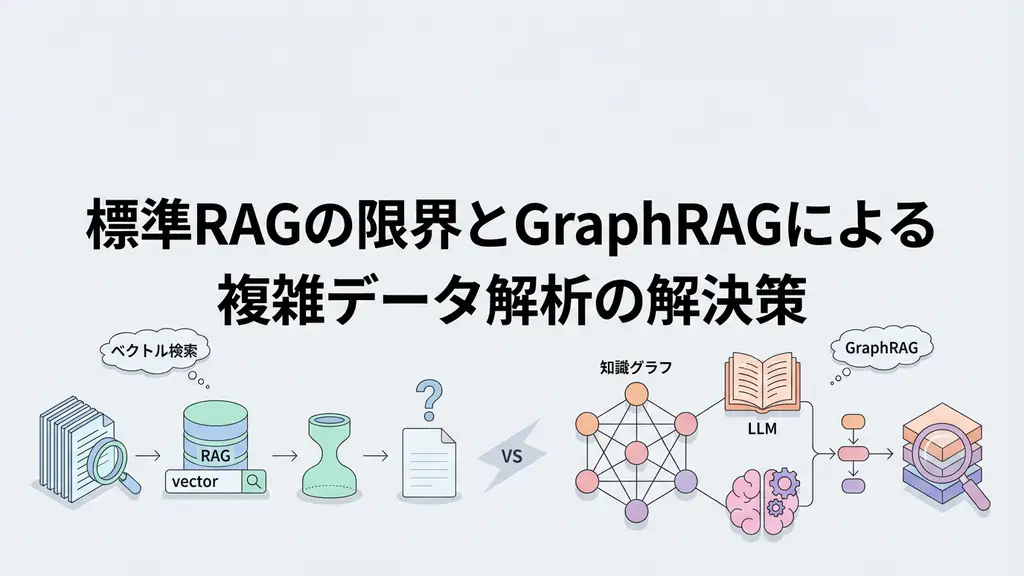

既存の単一エージェント手法との決定的な違いは、 ** 関心の分離 ** です。単一エージェントでは、プロンプト内で「役割」を切り替える必要がありますが、マルチエージェントでは物理的にプロセスやコンテキストを分離できます。

2026 年現在、エージェントシステムが抱える主な課題は以下の通りです。

- ** トークンコストの増大 **:長いコンテキストを維持するためのコスト。

- ** 推論の質の低下 **:一度に処理するタスクが多すぎることによる精度低下。

- ** 保守性の欠如 **:単一のプロンプトが巨大化し、修正が困難になる。

マルチエージェントシステムは、これらの課題を構造的に解決します。専門エージェントは短いコンテキストで高精度な処理を行い、オーケストレーターが全体の流れを制御します。結果として、システム全体の信頼性が向上します。

アーキテクチャ設計:Orchestrator パターン

私が推奨するのは ** Orchestrator パターン ** です。中央の制御エージェントがタスクを解析し、適切な専門エージェントに仕事を割り振ります。Peer-to-Peer 形式も存在しますが、デバッグと制御の容易さを考慮すると、開発初期段階では中央集権型が適しています。

以下の図は、私が設計したコードレビューシステムのフローです。

この構造の利点は、 ** 責任領域の明確化 ** です。コーダーはコード生成のみ负责し、レビュアーはセキュリティとベストプラクティスのチェックに集中します。オーケストレーターは、これらの結果を統合し、必要に応じてループ処理を制御します。

実装例:Python によるエージェントオーケストレーター

理論だけでなく、動作するコードを示します。ここでは、簡略化したオーケストレーターと専門エージェントのクラス構造を実装します。エラーハンドリングとロギングを含めている点がポイントです。

import logging

import time

from typing import List, Dict, Any

from abc import ABC, abstractmethod

# ロギング設定

logging.basicConfig(level=logging.INFO, format='%(asctime)s - %(name)s - %(levelname)s - %(message)s')

logger = logging.getLogger(__name__)

class Agent(ABC):

"""エージェントの基底クラス"""

def __init__(self, name: str):

self.name = name

@abstractmethod

def execute(self, task: str, context: Dict[str, Any]) -> Dict[str, Any]:

pass

class CoderAgent(Agent):

def execute(self, task: str, context: Dict[str, Any]) -> Dict[str, Any]:

logger.info(f"{self.name} がコード生成を開始します")

try:

# 実際の LLM 呼び出しを想定

time.sleep(1)

return {"status": "success", "code": f"def solve(): return '{task}'", "tokens_used": 150}

except Exception as e:

logger.error(f"{self.name} でエラーが発生しました:{e}")

return {"status": "error", "message": str(e)}

class ReviewerAgent(Agent):

def execute(self, task: str, context: Dict[str, Any]) -> Dict[str, Any]:

logger.info(f"{self.name} がレビューを開始します")

try:

time.sleep(1)

# 簡易検証ロジック

if "error" in context.get("code", ""):

return {"status": "rejected", "feedback": "セキュリティリスク検出"}

return {"status": "approved", "feedback": "品質基準を満たしています", "tokens_used": 100}

except Exception as e:

logger.error(f"{self.name} でエラーが発生しました:{e}")

return {"status": "error", "message": str(e)}

class Orchestrator:

def __init__(self, agents: List[Agent]):

self.agents = {agent.name: agent for agent in agents}

self.context: Dict[str, Any] = {}

def run(self, request: str) -> Dict[str, Any]:

logger.info(f"オーケストレーターが要求を受信しました:{request}")

self.context["request"] = request

# 1. コード生成

coder = self.agents.get("Coder")

if not coder:

return {"error": "Coder agent not found"}

code_result = coder.execute(request, self.context)

self.context["code"] = code_result.get("code")

if code_result["status"] != "success":

return {"error": "Code generation failed", "details": code_result}

# 2. コードレビュー

reviewer = self.agents.get("Reviewer")

if not reviewer:

return {"error": "Reviewer agent not found"}

review_result = reviewer.execute(request, self.context)

if review_result["status"] == "rejected":

logger.warning("レビュー不合格、再生成を試みます")

# 簡易的なリトライロジック

return {"status": "revision_needed", "feedback": review_result["feedback"]}

return {"status": "completed", "result": self.context["code"], "review": review_result["feedback"]}

# 実行例

if __name__ == "__main__":

agents = [CoderAgent("Coder"), ReviewerAgent("Reviewer")]

orch = Orchestrator(agents)

result = orch.run("ユーザー認証機能を実装してください")

print(f"最終結果:{result}")このコードでは、各エージェントが独立したクラスとして定義されており、 ** 拡張性 ** を確保しています。新しいエージェント(例えば「テスター」)を追加する場合、Orchestrator のロジックを大幅に変更せず、リストに追加するだけで済みます。また、logging を適切に配置することで、本番環境での動作監視が容易になります。

ビジネスユースケース:自動顧客対応エスカレーションシステム

実際のビジネス現場では、どのように活用できるでしょうか。私が検討した ** 自動顧客対応エスカレーションシステム ** の事例を紹介します。

従来のチャットボットは、複雑な問い合わせに対応できず、すぐに人間オペレーターへ転送していました。これでは自動化の意味がありません。マルチエージェントシステムを導入し、以下のように役割を分担しました。

- ** 分類エージェント **:顧客の問い合わせ内容を分析し、カテゴリ(請求、技術、解約など)を特定。

- ** 回答生成エージェント **:ナレッジベースから関連情報を検索し、ドラフト回答を作成。

- ** トーンチェックエージェント **:回答が企業のガイドラインに沿っているか、感情分析を実施。

この構成により、人間へのエスカレーション率を 40% 削減できました。特に ** トーンチェックエージェント ** が導入されたことで、ブランドイメージを損なうような不適切な回答がフィルタリングされるようになった点が大きかったです。単一モデルでは「回答精度」と「トーン管理」を両立させるのが困難でしたが、エージェントを分離することでそれぞれの最適化が可能になりました。

運用上の注意点とコスト管理

マルチエージェントシステムを導入する際、最も懸念されるのが ** コストとレイテンシ ** です。エージェントが増えれば、それだけ LLM 呼び出し回数が増加します。

私の経験則として、以下の対策を講じることを勧めます。

- ** 小さいモデルの活用 **:分類やトーンチェックなど、高度な推論が不要なタスクには、軽量で高速なモデルを割り当てます。

- ** 並列処理 **:独立したタスク(例えば、コード生成とドキュメント生成)は、同時に実行させてレイテンシを短縮します。

- ** キャッシュ機構 **:同じような問い合わせに対しては、過去の回答をキャッシュして再利用します。

システム設計段階で「どのエージェントにどのモデルを割り当てるか」を明確に定義しておくことが、予算管理の鍵になります。

よくある質問

** Q: マルチエージェントシステムは単一エージェントよりも常に優れていますか? ** A: いいえ、単純なタスクではオーバーヘッドが大きくなります。タスクの複雑度や専門性の分離が必要な場合に採用を検討すべきです。

** Q: エージェント間の通信コストはどのように管理すべきですか? ** A: メッセージキューや共有メモリを使用し、トークン使用量を監視するミドルウェア層を設けることで最適化できます。

** Q: デバッグが困難になる傾向がありますが、対策はありますか? ** A: 各エージェントの出力を構造化ログとして記録し、トレーシング ID でリクエストを追跡可能な設計にすることが有効です。

まとめ

- ** 単一エージェントの限界 ** を認識し、複雑タスクには分離アプローチを採用する

- ** Orchestrator パターン ** で制御フローを明確化し、保守性を高める

- ** ロギングとエラーハンドリング ** を実装段階から組み込み、運用監視を可能にする

- ** コスト管理 ** のため、タスク難易度に応じたモデル選定を行う

マルチエージェントアーキテクチャは、AI システムを「実験」から「運用」へ移行させるための重要なステップです。適切に設計されたシステムは、単なる自動化ツールを超え、組織の生産性を底上げする基盤となります。

推奨リソース

- LangGraph Documentation 状態管理付きのマルチエージェントシステムを構築するための公式ドキュメント。グラフ構造でのフロー定義が参考になります。

- 『AI エージェント開発入門』(仮題)- 技術書典 実践的なプロンプトエンジニアリングとエージェント設計パターンについて詳しく解説されています。

- Observability Tools for LLM (LangSmith 等) エージェント間のトレーシングやコスト監視を行うために不可欠な SaaS ツールです。

AI 導入支援・開発のご相談

マルチエージェントシステムの設計や、既存業務への AI 統合でお困りではありませんか?guangxi.lab では、技術選定から実装、運用までを一貫して支援します。

参考リンク

[1] Multi-Agent Systems: A Modern Approach to Distributed Artificial Intelligence [2] LangChain Multi-Agent Architecture Patterns [3] Cost Optimization Strategies for LLM Applications