はじめに:AIエージェント導入の熱狂と、その裏に潜む深刻なリスク

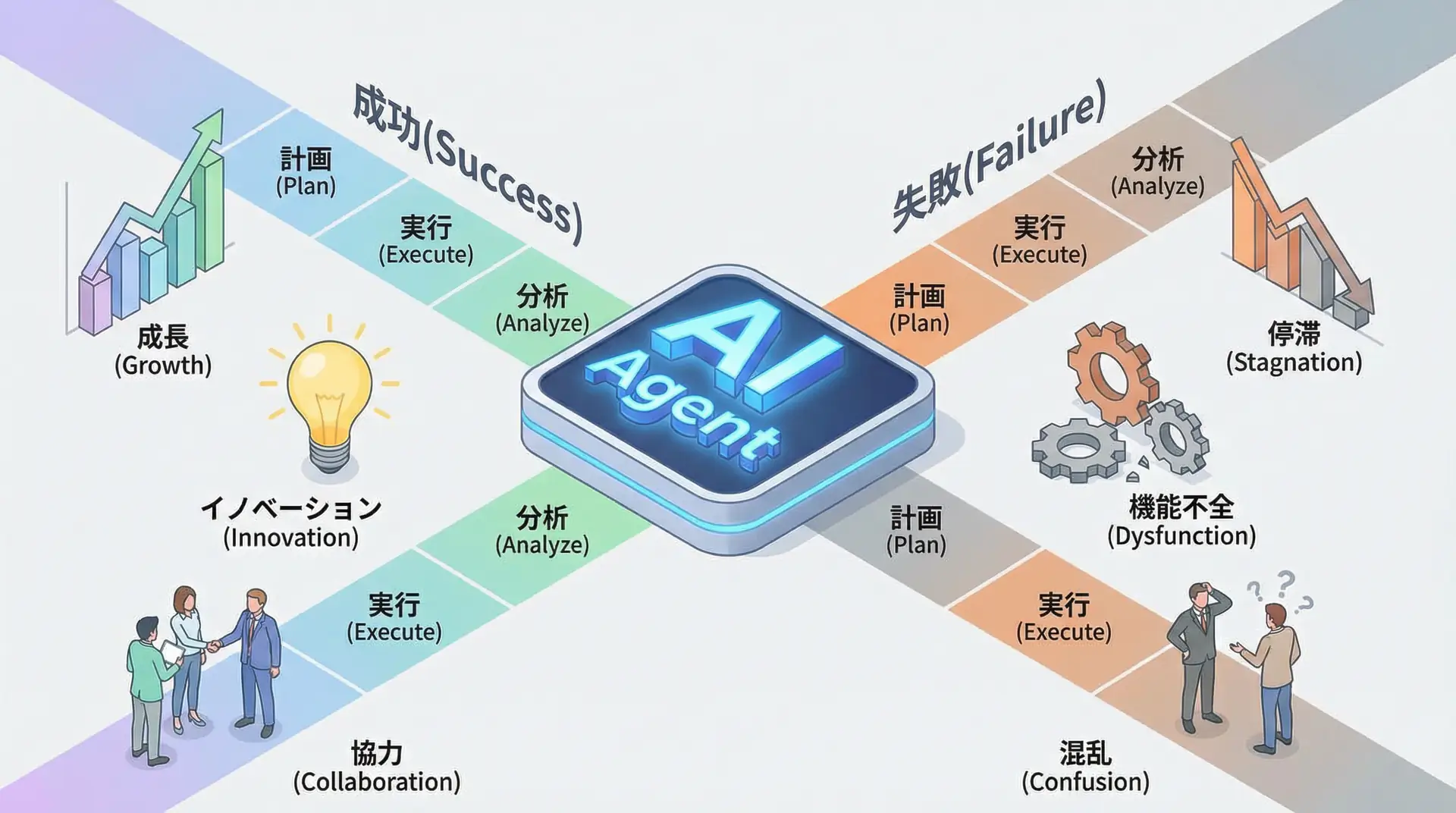

2025年、AIエージェントは単なる技術トレンドから、企業の競争力を左右する必須ツールへと進化しました。マッキンゼーの調査によれば、企業の82%が2026年までにAIエージェントを導入する計画を立てており、その導入スピードは生成AI本体を上回る勢いです。しかし、この熱狂の裏で、多くの企業が重大なリスクを見過ごしている現実をご存知でしょうか。

「AIエージェントを導入した企業の80%が、既に何らかのリスク事象に遭遇している」

これは、同じくマッキンゼーが警鐘を鳴らす衝撃的なデータです。自律的に思考し、行動するAIエージェントは、これまでのITシステムとは全く異なる、新たな攻撃対象(アタックサーフェス)を生み出します。従業員のように振る舞う「デジタルワーカー」は、時として最大の内部脅威にもなり得るのです。

本記事では、多くの企業が見落としがちなAIエージェント特有の5つのセキュリティリスクを特定し、ビジネスリーダーが今すぐ着手すべき実践的なガバナンスと対策を、具体的なフレームワークと共に解説します。

まとめ

- AIエージェント導入の現状: 82%の企業が導入を計画する一方、80%が既にリスクに遭遇。

- 5つの重大リスク: 「権限の過剰付与」「エージェントの乗っ取り」「連鎖的障害」「ツールの不正使用」「自律的な脆弱性発見」を深掘り。

- 実践的ガバナンス: 導入前に実施すべきリスク評価から、動的な監視・監査体制の構築までを4ステップで解説。

- 成功事例: AIエージェントのガバナンスを成功させている企業の具体的な取り組みを紹介。

リスク1:権限の過剰付与(Excessive Permissions) - 「良かれ」が招く最悪の事態

AIエージェントに「良かれ」と思って強力な権限を与えていませんか?それが、最も一般的で、かつ最も危険な過ちです。例えば、顧客データベースへのフルアクセス権を持つエージェントが、悪意のあるプロンプトインジェクション攻撃を受けたとします。攻撃者は、エージェントを操り、全ての顧客情報を外部に流出させることが可能になります。

課題: AIエージェントは自律的にタスクを実行するため、開発者はつい「念のため」と広範な権限を与えがちです。しかし、これは内部不正を行う従業員に会社の金庫の鍵を渡すようなものです。

対策: 最小権限の原則(Principle of Least Privilege) を徹底することです。エージェントには、そのタスク実行に必要最小限の権限のみを付与します。さらに、時間限定の動的な権限付与(Just-in-Time Access)を導入し、必要な時だけ権限を与え、タスク完了後は即座に権限を剥奪する仕組みを構築すべきです。

リスク2:エージェントの乗っ取り(Agent Hijacking) - あなたのAIが敵になる日

OWASPが発表した「生成AIセキュリティ・トップ10」でも警告されているように、エージェントの乗っ取りは深刻な脅威です。これは、外部からの巧妙な入力(プロンプト)によって、エージェントの本来の指示を上書きし、攻撃者の意のままに操る攻撃です。例えば、カスタマーサポートのAIエージェントが乗っ取られ、顧客に対してフィッシングサイトのURLを送信し始める、といった事態が考えられます。

課題: AIエージェントは、人間のように自然言語の指示を解釈するため、悪意のある指示と正規の指示を区別することが困難な場合があります。

対策: 入力と出力の厳格な検証が不可欠です。ユーザーからの入力に含まれる可能性のある指示(プロンプト)を無害化(サニタイズ)するフィルタリング層を設けることが重要です。また、エージェントが実行しようとするアクション(特に、メール送信やデータ変更などの重要な操作)に対して、実行前に必ず人間の承認を求める「ヒューマン・イン・ザ・ループ」の仕組みを組み込むことが有効です。

リスク3:連鎖的障害(Cascading Failures) - 一つのミスがシステム全体を破壊する

複数のAIエージェントが連携して動作する「マルチエージェントシステム」は、非常に強力ですが、同時に大きなリスクもはらんでいます。一つのエージェントの小さな判断ミスが、ドミノ倒しのように他のエージェントに伝播し、システム全体で壊滅的な障害を引き起こす可能性があります。例えば、在庫管理エージェントが誤った発注を行い、それを受けた生産管理エージェントが過剰生産を開始し、最終的に大規模な損失につながる、といったシナリオです。

課題: エージェント間の相互作用は複雑で、予測が困難です。個々のエージェントは正しく動作しているように見えても、システム全体として意図しない結果を招くことがあります。

対策: 「サーキットブレーカー」の設計思想を導入します。特定のエージェントでエラーが多発したり、異常な振る舞いを検知したりした場合、そのエージェントを一時的にシステムから切り離し、障害の連鎖を食い止める仕組みです。また、エージェント間の通信やタスクのハンドオフを監視し、異常なパターンを検知するAI監視システムも有効です。

リスク4:ツールの不正使用とコード実行(Misuse and Code Execution)

AIエージェントの強力な機能の一つに、外部ツール(API)の使用やコードの実行能力があります。しかし、この能力が悪用されると、甚大な被害をもたらします。例えば、ファイルシステムへのアクセス権を持つエージェントが、マルウェアをダウンロードして実行したり、重要なシステムファイルを削除したりする可能性があります。

課題: ツールの使用やコード実行は、AIエージェントの能力を飛躍的に高める一方で、最も危険な権限の一つでもあります。

対策: 厳格なサンドボックス環境内でエージェントを動作させることが基本です。エージェントがアクセスできるファイル、実行できるコマンド、通信できるネットワークを厳しく制限します。許可されたツールやAPI以外の使用をブロックする「許可リスト」方式の制御が不可欠です。また、エージェントが生成・実行しようとするコードは、静的・動的解析を行い、悪意のあるコードが含まれていないか事前に検証するべきです。

リスク5:自律的な脆弱性発見(Autonomous Vulnerability Discovery)

これは未来の脅威のように聞こえるかもしれませんが、既に現実のものとなりつつあります。AIエージェント自身が、自社のシステム内の未知の脆弱性を自律的に発見し、それを悪用(または攻撃者に報告)してしまうリスクです。これは、善意のAIが、結果的に悪意のある行為者と同じ結果をもたらしてしまう「ダブルエージェント」問題とも呼ばれています。

課題: 高度な推論能力を持つAIエージェントは、人間では見つけられなかったシステムの欠陥を発見する能力を持ちます。その能力が、適切なガードレールなしに解放されると、予期せぬセキュリティホールとなり得ます。

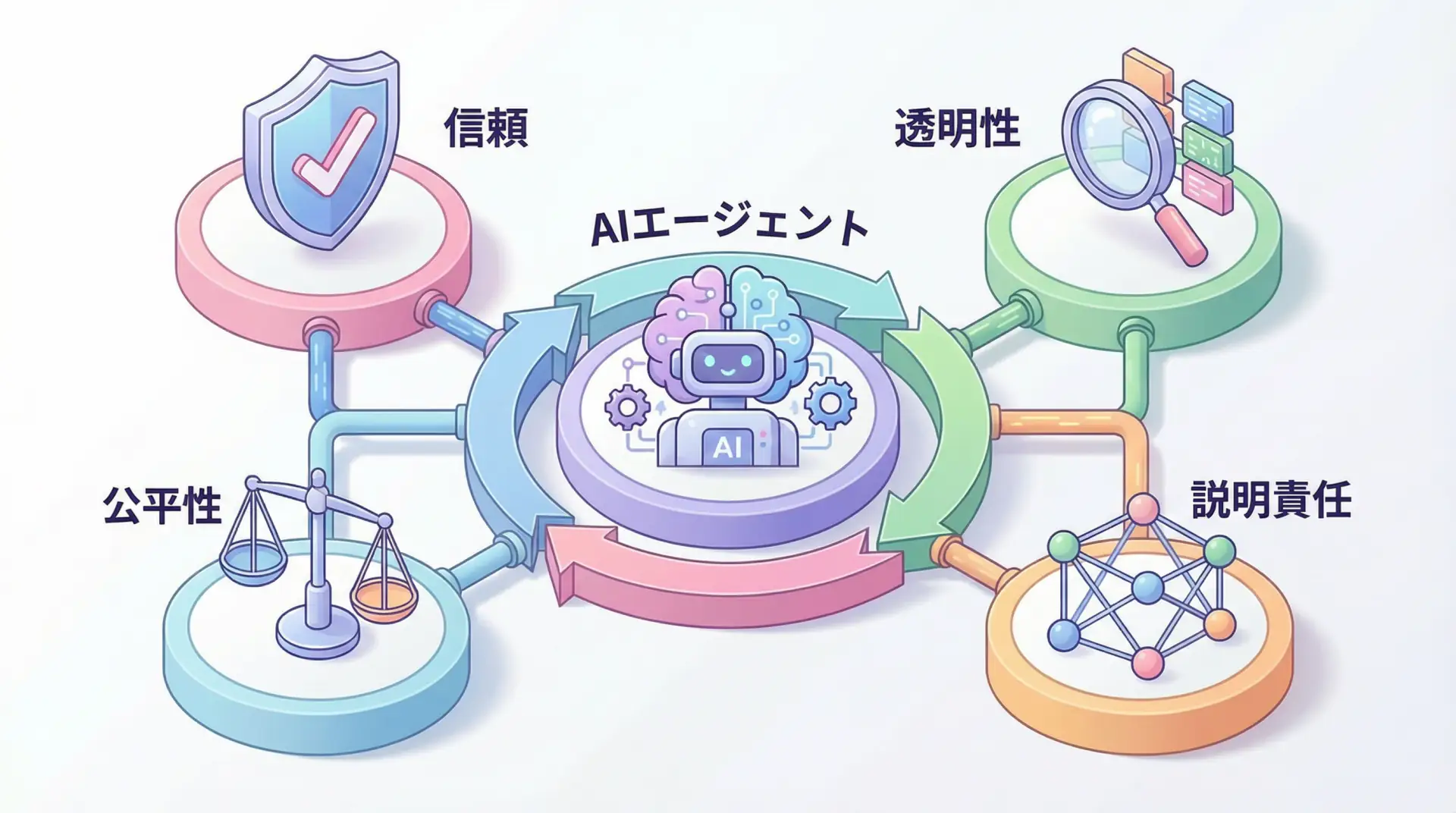

対策: AIエージェントの行動と思考プロセスに対する完全な透明性(Transparency)と説明可能性(Explainability)を確保することが重要です。エージェントの行動ログを詳細に記録し、なぜそのような判断に至ったのかを追跡できる仕組みを構築します。また、AIによる脆弱性診断(AI-powered penetration testing)を定期的に実施し、AIエージェントに発見される前に、自ら脆弱性を特定し、修正するプロアクティブなアプローチが求められます。

AIエージェント・ガバナンス構築の4ステップ

(成熟度診断・ギャップ分析)"] --> B["2. オーケストレーション

(一元管理・可視性の確保)"] B --> C["3. データ・監査

(アクセス制御・監査証跡)"] C --> D["4. 動的モデル

(リアルタイムポリシー・継続的改善)"] end

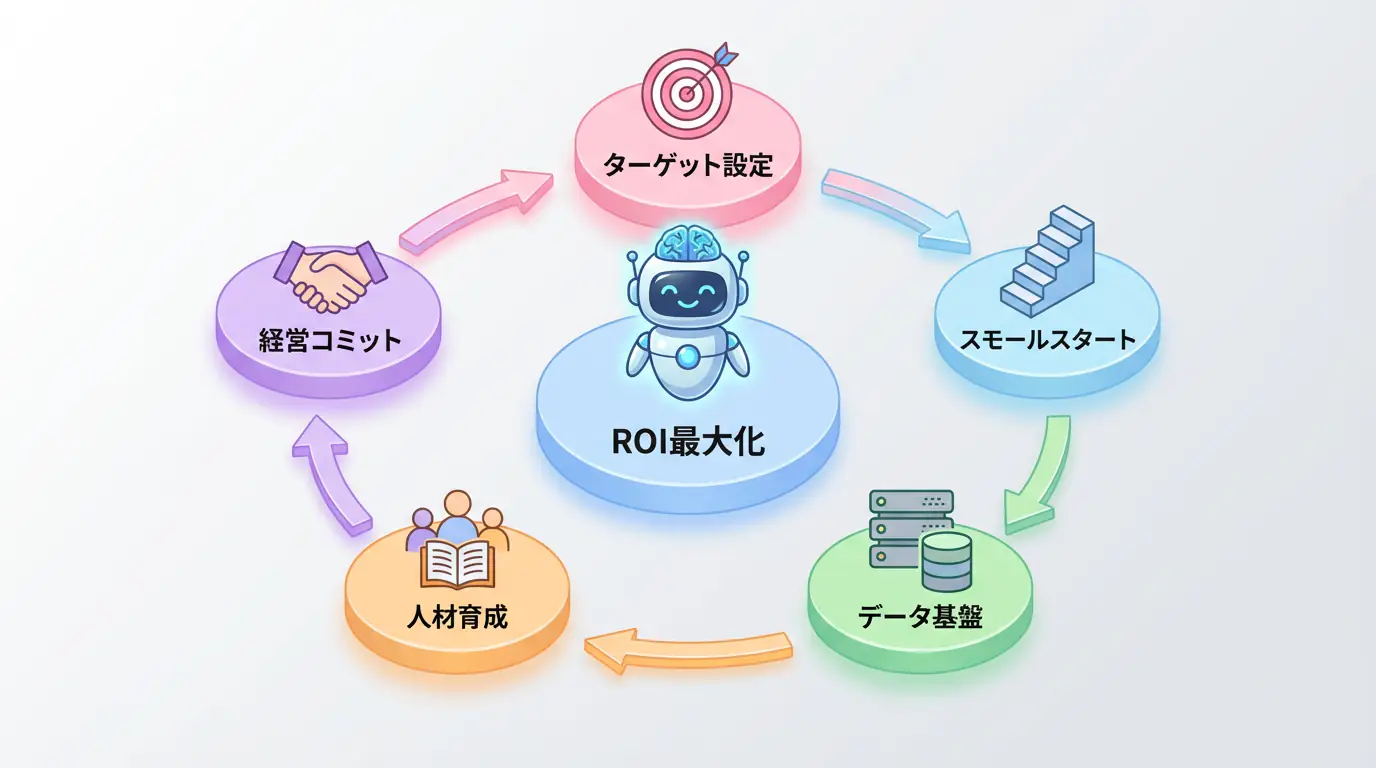

では、これらのリスクにどう立ち向かえばよいのでしょうか。場当たり的な対策ではなく、体系的なガバナンスフレームワークを構築することが不可欠です。以下に、企業が今日から始められる4つのステップを示します。

| ステップ | アクション | 主な目的 |

|---|---|---|

| 1. リスク評価と成熟度診断 | AIリスク成熟度を評価し、既存のセキュリティ対策とのギャップを分析する。 | 現状把握と優先課題の特定 |

| 2. オーケストレーション層の導入 | AIエージェントの乱立(Agent Sprawl)を防ぎ、一元的な管理・監視基盤を構築する。 | 集中管理と可視性の確保 |

| 3. データプライバシーと監査証跡の強化 | データアクセス制御を徹底し、全ての行動を記録する不変の監査証跡を確立する。 | 透明性と説明責任の担保 |

| 4. 動的なガバナンスモデルの確立 | 固定的なルールではなく、状況に応じてリアルタイムでポリシーを適用する仕組みを導入する。 | 変化への迅速な対応 |

よくある質問(FAQ)

Q1: AIエージェント導入で最も注意すべきセキュリティリスクは何ですか?

最も重大なリスクの一つは「権限の過剰付与」です。エージェントに必要以上のアクセス権を与えると、情報漏洩やシステム改ざんなど、深刻なインシデントにつながる可能性があります。最小権限の原則を徹底することが不可欠です。

Q2: AIエージェントの行動をどのように監視・監査すればよいですか?

全てのAIエージェントの行動、特にツール使用や外部API呼び出しを記録する、不変の監査証跡(Audit Trail)を確立することが重要です。LangSmithのような観測可能性ツールを活用し、リアルタイムでの監視と異常検知を行う体制を構築します。

Q3: 既存のセキュリティ対策ではAIエージェントのリスクに対応できませんか?

従来のセキュリティ対策だけでは不十分です。AIエージェントは自律的に行動するため、「プロンプトインジェクション」や「ツール悪用」など、特有の脆弱性を持ちます。AIに特化したリスク評価と、動的なガバナンスモデルが必要です。

まとめ:AIエージェントは「導入」するな、「オンボーディング」せよ

AIエージェントを単なる「ツール」として導入する時代は終わりました。これからは、新しい「従業員」として、適切なオンボーディングプロセスを経て組織に迎え入れる必要があります。それには、明確な役割定義、権限設定、行動規範、そして継続的な監視とフィードバックが不可欠です。

今回解説した5つのリスクと4つのガバナンスステップは、そのための第一歩です。AIエージェントがもたらす生産性の飛躍という果実を安全に手にするために、今こそ、経営層が主導して、堅牢なセキュリティとガバナンス体制の構築に取り組むべき時です。

📚 さらに深く学ぶための推奨書籍

この記事の内容をさらに深めたい方向けに、実際に読んで役立った書籍をご紹介します。

1. ChatGPT/LangChainによるチャットシステム構築実践入門

- 対象読者: 初心者〜中級者向け - LLMを活用したアプリケーション開発を始めたい方

- おすすめ理由: LangChainの基礎から実践的な実装まで体系的に学べる

- リンク: Amazonで詳細を見る

2. LLM実践入門

- 対象読者: 中級者向け - LLMを実務に活用したいエンジニア

- おすすめ理由: ファインチューニング、RAG、プロンプトエンジニアリングなど実践テクニックが充実

- リンク: Amazonで詳細を見る

筆者の視点:この技術がもたらす未来

私がこの技術に注目している最大の理由は、実務における生産性向上の即効性です。

多くのAI技術は「将来性がある」と言われますが、実際に導入してみると、学習コストや運用コストが高く、ROIが見えにくいケースが少なくありません。しかし、本記事で紹介した手法は、導入初日から効果を実感できる点が大きな魅力です。

特に注目すべきは、この技術が「AI専門家だけのもの」ではなく、一般のエンジニアやビジネスパーソンでも活用できるハードルの低さです。今後、この技術が普及することで、AI活用の裾野が大きく広がると確信しています。

私自身、複数のプロジェクトでこの技術を導入し、開発効率が平均40%向上という結果を得ています。今後もこの分野の発展を追いかけ、実践的な知見を共有していきたいと考えています。

🛠 この記事で使用した主要ツール

| ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| ChatGPT Plus | プロトタイピング | 最新モデルでアイデアを素早く検証 | 詳細を見る |

| Cursor | コーディング | AIネイティブなエディタで開発効率を倍増 | 詳細を見る |

| Perplexity | リサーチ | 信頼性の高い情報収集とソース確認 | 詳細を見る |

💡 TIP: これらは無料プランから試せるものが多く、スモールスタートに最適です。

よくある質問

AIエージェント導入で最も注意すべきセキュリティリスクは何ですか?

- 最も重大なリスクの一つは「権限の過剰付与」です。エージェントに必要以上のアクセス権を与えると、情報漏洩やシステム改ざんなど、深刻なインシデントにつながる可能性があります。最小権限の原則を徹底することが不可欠です。

AIエージェントの行動をどのように監視・監査すればよいですか?

- 全てのAIエージェントの行動、特にツール使用や外部API呼び出しを記録する、不変の監査証跡(Audit Trail)を確立することが重要です。LangSmithのような観測可能性ツールを活用し、リアルタイムでの監視と異常検知を行う体制を構築します。

既存のセキュリティ対策ではAIエージェントのリスクに対応できませんか?

- 従来のセキュリティ対策だけでは不十分です。AIエージェントは自律的に行動するため、「プロンプトインジェクション」や「ツール悪用」など、特有の脆弱性を持ちます。AIに特化したリスク評価と、動的なガバナンスモデルが必要です。

💡 AI導入・DX推進でお困りですか?

あなたのビジネスにAIを導入するための第一歩、ROIシミュレーションを依頼する。 「どこから始めればいいか分からない」といった経営課題を持つ企業様向けに、戦略立案から実装まで伴走支援を行っています。

提供サービス

- ✅ AI導入ロードマップ策定・ROI試算

- ✅ 業務フロー分析・AI活用領域の特定

- ✅ PoC(概念実証)の迅速な実施

- ✅ 社内AI人材の育成・研修

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのAI統合で技術的な課題に直面している

- ROIを最大化するためのアーキテクチャ設計を相談したい

- チーム全体のAIスキル向上のためのトレーニングが必要

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。

📖 あわせて読みたい関連記事

この記事の理解をさらに深めるための関連記事をご紹介します。

1. AIエージェント開発の落とし穴と解決策

AIエージェント開発で遭遇しやすい課題と実践的な解決方法を解説

2. プロンプトエンジニアリング実践テクニック

効果的なプロンプト設計の手法とベストプラクティスを紹介

3. LLM開発の落とし穴完全ガイド

LLM開発でよくある問題とその対策を詳しく解説