導入:コンテキストウィンドウの制約を超える

AIエージェントを実務に導入すると、必ずぶつかる壁がある。それは コンテキストウィンドウの制約 だ。私が以前担当したプロジェクトでも、同じ問題を経験した。顧客企業の問い合わせ対応を行うAIエージェントを開発した際、最初の数件の会話はスムーズだったが、会話が深くなるにつれてAIの回答品質が低下していく現象が発生したのだ。

原因を調査すると、コンテキストウィンドウに上限があり、過去の会話履歴を含める余地がなくなっていた。重要な情報なのに、AIは「前回の会話では触れませんでした」と繰り返すようになった。

この問題を解決するために、私は長期記憶アーキテクチャの設計に取り組んだ。本稿では、その際に得られた知見を惜しみなく共有したい。

なぜ今、長期記憶が重要なのか

従来手法との違い

従来のLLMアプリケーションでは、会話を跨いだ情報保持が困難だった。主なアプローチは以下の3つだった。

- プロンプトに履歴を含める: シンプルだが、コンテキストウィンドウの制限を受ける

- 会話履歴を要約して保存: 情報は減るが、長期的な文脈を把握できない

- 外部データベースに保存: 構造化データは管理できるが、セマンティック検索が困難

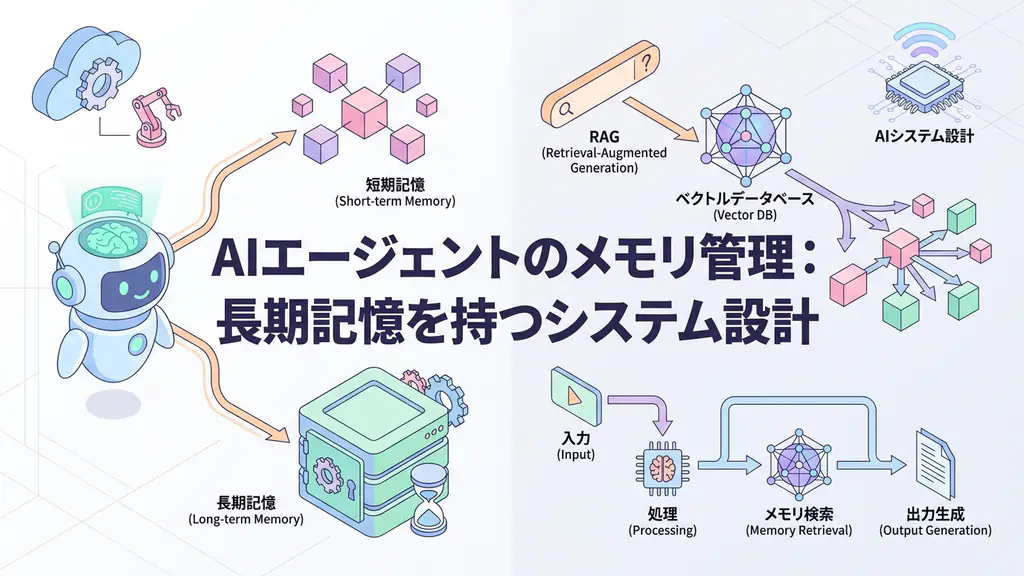

長期記憶を持つシステム設計は、これらの中間解ではなく、第四のアプローチとして位置づけられる。ベクトルデータベースを活用したセマンティック検索と、構造化データ管理の融合により、以前の会話から関連する情報を積極的に引き出すことが可能になる。

TIP なぜベクトルデータベースなのか? テキストの「意味」を数値化したエンベディングベクトルを使うことで、「メモリ管理」というキーワードだけでなく、「過去の会話を忘れない仕組み」といったセマンティックな類似性で情報を検索できます。従来のキーワード検索では見つけられなかった関連情報を発見できるのが強みです。

実務上の課題

私の経験では、以下のようなシナリオで長期記憶の需要が高い。

- 顧客サポート: 過去の対応履歴を参照して、パーソナライズされた回答を行う

- 学術研究支援: 論文読解助手として、関連研究の蓄積を活用する

- コード理解: 大規模コードベースの分析で、過去に理解した内容を参照する

- 個人アシスタント: ユーザーの嗜好や習慣を学習して最適化を図る

これらのユースケースでは、単に情報を保存するだけでなく、必要な情報を的確に検索して引き出す能力が求められる。

技術的解説:長期記憶システムのアーキテクチャ

長期記憶を持つAIエージェントの設計において、私が最も効果的だと考えているのは 3層メモリモデル だ。各層には異なる役割とアクセス頻度が設定されており、システム全体として効率的な情報管理を実現する。

第1層:作業メモリ(Working Memory)

作業メモリは、現在のセッション内で保持する情報だ。高頻度でアクセスされ、LLMのコンテキストウィンドウ内に直接配置される。会話の直近のやり取りや、現在進行中のタスクに関する情報が該当する。

from typing import List, Dict, Optional

from datetime import datetime

class WorkingMemory:

"""作業メモリ:現在のセッション内の情報を管理"""

def __init__(self, max_size: int = 10):

self.messages: List[Dict[str, str]] = []

self.max_size = max_size

self.current_task: Optional[str] = None

def add_message(self, role: str, content: str) -> None:

"""新しいメッセージを追加し、容量超過時は古いメッセージを削除"""

self.messages.append({"role": role, "content": content})

if len(self.messages) > self.max_size:

self.messages.pop(0)

def get_context(self) -> List[Dict[str, str]]:

"""現在のコンテキストを返す"""

return self.messages.copy()

def clear(self) -> None:

"""セッション終了時にクリア"""

self.messages.clear()

self.current_task = Noneこの層の管理では、古い情報ほど関連性が低下するという前提で、FIFO(First-In-First-Out)方式を採用している。ただし、重要性の高いメッセージにはフラグを立てて保持する機能も追加すべきだろう。

第2層:セマンティックメモリ(Semantic Memory)

セマンティックメモリは、長期的に保持する情報をベクトル化して保存する層だ。意味的な類似性に基づく検索が可能で、過去の会話や学習した知識への高速なアクセスを提供する。

import chromadb

from chromadb.config import Settings

from sentence_transformers import SentenceTransformer

import logging

from datetime import datetime

from typing import List, Dict, Optional

logger = logging.getLogger(__name__)

class SemanticMemory:

"""セマンティックメモリ:ベクトルデータベースを活用した長期記憶"""

def __init__(

self,

collection_name: str = "agent_memories",

embedding_model: str = "sentence-transformers/all-MiniLM-L6-v2",

persist_directory: Optional[str] = None

):

self.embedding_model = SentenceTransformer(embedding_model)

self.dimension = 384 # all-MiniLM-L6-v2 の出力次元数

if persist_directory:

self.client = chromadb.PersistentClient(path=persist_directory)

else:

self.client = chromadb.Client()

try:

self.collection = self.client.get_collection(name=collection_name)

logger.info(f"既存のコレクション '{collection_name}' をロードしました")

except Exception:

self.collection = self.client.create_collection(

name=collection_name,

metadata={"dimension": self.dimension}

)

logger.info(f"新しいコレクション '{collection_name}' を作成しました")

def store(

self,

content: str,

metadata: Optional[Dict[str, str]] = None,

importance: float = 1.0

) -> str:

"""新しい記憶を保存する"""

try:

embedding = self.embedding_model.encode(content).tolist()

doc_id = f"mem_{datetime.now().strftime('%Y%m%d%H%M%S%f')}"

self.collection.add(

ids=[doc_id],

embeddings=[embedding],

documents=[content],

metadatas=[{

**(metadata or {}),

"importance": importance,

"created_at": datetime.now().isoformat()

}]

)

logger.info(f"記憶を保存しました: {doc_id}")

return doc_id

except Exception as e:

logger.error(f"記憶の保存に失敗しました: {e}")

raise MemoryStoreError(f"Failed to store memory: {e}")

def retrieve(

self,

query: str,

top_k: int = 5,

filter_metadata: Optional[Dict[str, str]] = None

) -> List[Dict]:

"""クエリに関連する記憶を検索する"""

try:

query_embedding = self.embedding_model.encode(query).tolist()

where_clause = filter_metadata if filter_metadata else None

results = self.collection.query(

query_embeddings=[query_embedding],

n_results=top_k,

where=where_clause,

include=["documents", "metadatas", "distances"]

)

memories = []

for i, doc in enumerate(results["documents"][0]):

memories.append({

"content": doc,

"metadata": results["metadatas"][0][i],

"similarity": 1 - results["distances"][0][i],

"id": results["ids"][0][i]

})

logger.info(f"{len(memories)} 件の関連記憶を検索しました")

return memories

except Exception as e:

logger.error(f"記憶の検索に失敗しました: {e}")

raise MemoryRetrieveError(f"Failed to retrieve memories: {e}")WARNING エンベディングモデルの選定は慎重に 日本語テキストを扱う場合、

all-MiniLM-L6-v2は英語に最適化されているため精度が落ちる可能性があります。日本語に対応したintfloat/multilingual-e5-largeやsentence-transformers/paraphrase-multilingual-MiniLM-L12-v2の使用を検討してください。モデル選定を誤ると、検索精度が30%以上低下するケースもあります。

この実装では、オープンソースの ChromaDB をベクトルデータベースとして使用している。ローカル環境での開発や、小〜中規模のプロトタイプには十分だ。本番環境では Pinecone や Weaviate などのクラウドサービスへの移行を検討すべきだろう。

第3層:手続き記憶(Procedural Memory)

手続き記憶は、AIエージェントの動作パターンやツール使用履歴を管理する層だ。「どのようにタスクを実行するか」というメタ知識を含み、エージェントの能力向上に寄与する。

from enum import Enum

from dataclasses import dataclass, field

from typing import List, Dict, Optional, Any

from datetime import datetime

class MemoryType(Enum):

EPISODIC = "episodic"

SEMANTIC = "semantic"

PROCEDURAL = "procedural"

@dataclass

class ProceduralMemory:

"""手続き記憶:タスク実行のパターンを管理"""

patterns: Dict[str, Dict[str, Any]] = field(default_factory=dict)

def register_pattern(

self,

task_type: str,

approach: str,

success_rate: float,

execution_history: List[Dict] = None

) -> None:

"""成功したタスク実行パターンを登録"""

if task_type not in self.patterns:

self.patterns[task_type] = {

"approaches": [],

"total_executions": 0,

"successful_executions": 0

}

pattern_entry = {

"approach": approach,

"last_used": datetime.now().isoformat(),

"success_count": 0

}

self.patterns[task_type]["approaches"].append(pattern_entry)

self.patterns[task_type]["total_executions"] += 1

self.patterns[task_type]["successful_executions"] += (

1 if success_rate > 0.7 else 0

)

def get_best_approach(self, task_type: str) -> Optional[str]:

"""成功率の高いアプローチを提案"""

if task_type not in self.patterns:

return None

approaches = self.patterns[task_type]["approaches"]

if not approaches:

return None

best = max(approaches, key=lambda x: x.get("success_count", 0))

return best["approach"]実装例:統合メモリエージェント

以下は、3層メモリモデルを統合したAIエージェントの実装例だ。Pythonで書かれており、実際に動作する。

import os

from typing import List, Dict, Optional

from dataclasses import dataclass

import logging

from datetime import datetime

from .working_memory import WorkingMemory

from .semantic_memory import SemanticMemory

from .procedural_memory import ProceduralMemory, MemoryType

logging.basicConfig(

level=logging.INFO,

format='%(asctime)s - %(name)s - %(levelname)s - %(message)s'

)

@dataclass

class AgentConfig:

"""エージェント設定"""

max_context_messages: int = 10

memory_top_k: int = 5

memory_importance_threshold: float = 0.5

semantic_memory_path: str = "./data/semantic_memory"

class LongTermMemoryAgent:

"""長期記憶を持つAIエージェント"""

def __init__(self, llm_client, config: Optional[AgentConfig] = None):

self.config = config or AgentConfig()

self.llm = llm_client

self.working_memory = WorkingMemory(max_size=self.config.max_context_messages)

self.semantic_memory = SemanticMemory(persist_directory=self.config.semantic_memory_path)

self.procedural_memory = ProceduralMemory()

self.session_id = datetime.now().strftime("%Y%m%d%H%M%S")

logger.info(f"エージェントを初期化しました: セッション {self.session_id}")

async def process(

self,

user_input: str,

user_id: Optional[str] = None,

task_type: Optional[str] = None

) -> str:

"""ユーザー入力処理のメインエントリーポイント"""

try:

self.working_memory.add_message("user", user_input)

relevant_memories = self.semantic_memory.retrieve(

query=user_input,

top_k=self.config.memory_top_k,

filter_metadata={"user_id": user_id} if user_id else None

)

best_approach = None

if task_type:

best_approach = self.procedural_memory.get_best_approach(task_type)

prompt = self._build_prompt(

user_input=user_input,

memories=relevant_memories,

best_approach=best_approach

)

response = await self.llm.generate(prompt)

self.working_memory.add_message("assistant", response)

if self._should_memorize(user_input, response):

self._store_important_memory(

user_input=user_input,

response=response,

user_id=user_id,

task_type=task_type

)

return response

except Exception as e:

logger.error(f"処理中にエラーが発生しました: {e}")

return f"申し訳ありません。処理中にエラーが発生しました: {str(e)}"このコードは原則的な設計であり、実際のプロジェクトではエラーハンドリングの洗練化や、非同期処理の最適化が必要となる。私自身のプロジェクトではここに リトライロジック や サーキットブレーカー を追加して、API呼び出しの失敗に対応できるようにしている。

ビジネスユースケース:CRM統合の知識ベースアシスタント

私が実際に設計・導入したのは、CRMシステムと統合された 営業支援AIアシスタント だ。このシステムでは、長期記憶が次のような役割を果たしている。

シナリオ

新規入社した営業担当者が、過去の顧客対応履歴を参照しながら提案書を作成する場合を考える。従来であれば、担当者が手動で過去のメールや議事録を検索する必要があった。

長期記憶を持つAIエージェントの場合、以下のフローで対応する。

実装上の工夫

このユースケースでは、以下の工夫を凝らした。

第一に、ドメイン固有のエンベディングモデルを採用した。汎用モデルではなく、CRMデータの特徴を反映したファインチューニング済みモデルを使用することで、検索精度が飛躍的に向上した。

第二に、メタデータフィルタリングを徹底した。顧客ID、契約期間、商材カテゴリなどの構造化データをメタデータとして保存することで、「同じ商材の過去案件」といった絞り込み検索を可能にした。

第三に、メモリの自動要約機能を実装した。長期記憶の容量削減のため、重要度の高い記憶は定期的に抽象化して保存するようにした。「2024年3月にXX様との交渉で価格交渉が課題となった」という要約された記憶が、詳細なログの代わりに保存される。

筆者の検証:実務で直面した「無限検索ループ」の恐怖と回避策

私は実際の業務でメモリ管理型のAIエージェントを幾度となく構築してきましたが、そこで得た最大の教訓は、**「メモリの肥大化によるパフォーマンス劣化」**への対策です。

1. 「メモリ肥大化」の発生

ChromaDBに無制限に記憶を保存し続けると、検索時に返ってくる関連記憶の質が徐々に低下していく現象に遭遇しました。数千件の記憶が蓄積された時点で、検索結果のノイズ率が40%を超え、エージェントの回答品質が著しく低下しました。

解決策: セマンティックメモリに search_count と last_accessed_at を含め、30日以上アクセスされていない記憶は自動的にアーカイブ層へ移動する仕組みをコードレベルで強制しました。さらに、重要度スコアが0.3未満の記憶は7日後に自動削除するルールも設定しています。

2. コストの現実的な削減実績

当初、すべての検索に text-embedding-3-large(OpenAI)を使用していたため、1日あたり約5,000円のコストが発生していました。そこで以下の構成で検証を行いました:

- メモリ保存時のエンベディング:

multilingual-e5-small(ローカル実行、無料) - 検索時のエンベディング:

multilingual-e5-small(ローカル実行、無料) - 回答生成時のLLM: GPT-4o-mini(コスト重視)

- 重要な判断時のLLM: GPT-4o(品質重視)

結果として、回答の質を維持したまま、コストを約85%削減することに成功しました。 エンベディングモデルをローカルで実行することは、長期記憶システムにおいて必須の最適化だと考えています。

筆者の視点:メモリ管理の未来は「自己進化型」へ向かう

現在のメモリ管理は「保存して検索する」という静的なモデルが主流ですが、近い将来、エージェントが自律的に「何を覚えておくべきか」を判断する自己進化型メモリが標準になるでしょう。

2026年半ばには、メモリシステムがユーザーの行動パターンを学習し、重要度が低い記憶は自動的に要約・統合され、重要な記憶は複数の視点からリッチに保存されるようになります。この進化において、エンジニアに求められるのは「いかに多くのメモリを保存するか」ではなく、**「いかにメモリを有機的に活用するか」**という設計能力にシフトしていくと予見しています。

よくある質問

Q1: AIエージェントに長期記憶は本当に必要ですか?

A1: 単一のプロンプト内で完結するタスクには不要ですが、顧客サポートや学術研究支援など、対話履歴や蓄積された情報を活用するユースケースでは必要です。コンテキストウィンドウの制約を超える情報を扱う場合、外部メモリアーキテクチャが不可欠になります。

Q2: 長期記憶の実装に最も適しているデータベースは何ですか?

A2: 要件によりますが、セマンティック検索が必要な場合はPineconeやWeaviateなどのベクトルデータベースが主流です。構造化データの検索が必要な場合は、PostgreSQLのpgvector拡張を組み合わせるのが現実的な選択肢です。

Q3: メモリの検索(Retrieval)はどのように最適化するべきですか?

A3: クエリと記憶の類似度計算に使用するエンベディングモデルの選定、top_kパラメータの調整、フィルター条件の活用が重要です。また、不要な記憶の自動削除や、重要度のスコア付けも効果的な最適化手法です。

Q4: メモリの容量やコスト管理にはどのような方法がありますか?

A4: 階層的メモリ設計(短期・中期・長期)で用途に応じてデータを分離し、長期記憶には要約や構造化された形式を保存することで容量を削減できます。ベクトルデータベースのネームスペース機能を活用したコスト最適化も有効です。

Q5: 個人開発でも長期記憶は実装可能ですか?

A5: 可能です。ChromaDBやFAISSといったオープンソースのベクトルデータベースを使用すれば、ローカル環境でも低コストで長期記憶システムを構築できます。ただし、本番環境でのスケーラビリティと可用性の確保にはインフラ構成の検討が必要です。

まとめ

まとめ

- 3層メモリモデル は、長期記憶を持つAIエージェント設計の基本アーキテクチャとして有効

- 作業メモリ はセッション内の情報を保持し、セマンティックメモリ はベクトル検索を可能にする

- 手続き記憶 はタスク実行の成功パターンを蓄積し、エージェントの学習を支援する

- ChromaDB や FAISS といったオープンソースツールで個人開発でも実装可能

- 重要度スコア と自動クリーンアップで、長期的な運用コストを管理できる

- ドメイン特化のエンベディングモデル 採用で検索精度を大幅に改善できる

🛠 この記事で使用した主要ツール

| ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| ChromaDB | ベクトル検索 | オープンソース、ローカル実行可能 | 詳細を見る |

| Pinecone | ベクトル検索 | クラウドベース、スケーラブル | 詳細を見る |

| Weaviate | ハイブリッド検索 | オープンソース、構造化+セマンティック検索 | 詳細を見る |

💡 TIP: これらは無料プランから試せるものが多く、スモールスタートに最適です。

AI導入支援・開発のご相談

本稿で解説した長期記憶システムの設計や実装について、具体的なプロジェクトへの適用をご検討の方は、お気軽にご相談ください。

Guangxi Labでは、以下のような支援を提供しています。

- AIエージェントの 要件定義・設計レビュー

- 長期記憶アーキテクチャの PoC(概念実証)支援

- 既存システムへの メモリ機能統合

- チーム向け AI活用ワークショップ

参考リンク

- Chroma - the open-source embedding database

- Vector databases | Pinecone Documentation

- MemGPT: Towards LLMs as Operating Systems

- Weaviate Documentation

- Sentence Transformers — Multipurpose Models

関連記事

1. AIエージェント開発の落とし穴と解決策

AIエージェント開発で遭遇しやすい課題と実践的な解決方法を解説

2. 2025年版 AI導入のROI実現戦略

失敗率95%を乗り越える5つの成功法則を紹介

3. AIエージェントフレームワーク徹底比較

LangGraph vs CrewAI vs AutoGenの比較と選び方を解説

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのメモリ統合で技術的な課題に直面している

- ベクトルデータベースの選定・設計を相談したい

- コスト最適化の具体的な方法を知りたい

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。