なぜ8割のAIエージェントはPoCで終わるのか?

2025年、AIエージェント開発は技術的な挑戦から、ビジネス価値を創出する実践的なフェーズへと移行しました。しかし、多くのプロジェクトが概念実証(PoC)の段階で頓挫し、本番環境に到達できずにいます。一体なぜでしょうか?

LangChainが最近公開した「State of AI Agent Engineering」の調査結果は、その核心を突いています。開発者が直面する最大の課題として「デバッグの難しさ(28%)」が挙げられ、次いで「レイテンシー(遅延)(20%)」が続きます。これは、私自身の開発経験とも非常によく一致します。

調査結果の衝撃 AIエージェント開発者の約半数が、デバッグとパフォーマンスの問題に直面している。これは、単にコードを書く以上の、新たなエンジニアリング課題が浮上していることを示唆しています。

本記事では、こうした調査結果や私の実体験に基づき、多くの開発者が陥りがちな7つの致命的な落とし穴と、それらを回避するための実践的な戦略を、具体的なツールやコード例を交えながら徹底的に解説します。この記事を読めば、あなたのAIエージェント開発の成功率を格段に引き上げることができるはずです。

落とし穴1: 「とりあえず作ってみる」という不明確なユースケース

最もよくある失敗が、「何ができるか」ではなく「何を作るか」から始めてしまうことです。Kore.aiも指摘するように、明確なユースケースの欠如はプロジェクト失敗の最大の原因です。

「顧客対応を自動化したい」といった漠然とした目標では、エージェントはすぐに道に迷います。そうではなく、「返品リクエストのうち、購入後30日以内で未使用の製品に関する一次対応を自動化し、オペレーターの対応時間を20%削減する」のように、具体的で測定可能な課題に絞り込む必要があります。

TIP 課題解決フレームワーク

- Problem: 解決したい具体的なビジネス課題は何か?

- Solution: AIエージェントはその課題をどう解決するのか?

- Metric: 成功をどう測定するのか? (例: 処理時間、コスト、顧客満足度)

このフレームワークに当てはまらないアイデアは、時期尚早かもしれません。

落とし穴2: 「ゴミを入れればゴミが出てくる」データ品質の問題

特にRAG(Retrieval-Augmented Generation)ベースのエージェントにおいて、データの品質はエージェントの思考品質に直結します。古いドキュメント、不正確な情報、一貫性のないフォーマットのデータを知識ベースとして与えれば、エージェントは自信を持って間違った回答を生成してしまいます。これは、カンニングペーパー自体が間違っているようなものです。

回避策:

- データクレンジングの徹底: 知識ソースを定期的にレビューし、最新かつ正確な情報に保つプロセスを構築する。

- チャンキング戦略の最適化: 情報を適切なサイズに分割(チャンキング)し、埋め込みモデルの特性に合わせて調整する。

- ハイブリッド検索の導入: キーワード検索とベクトル検索を組み合わせ、検索精度を向上させる。

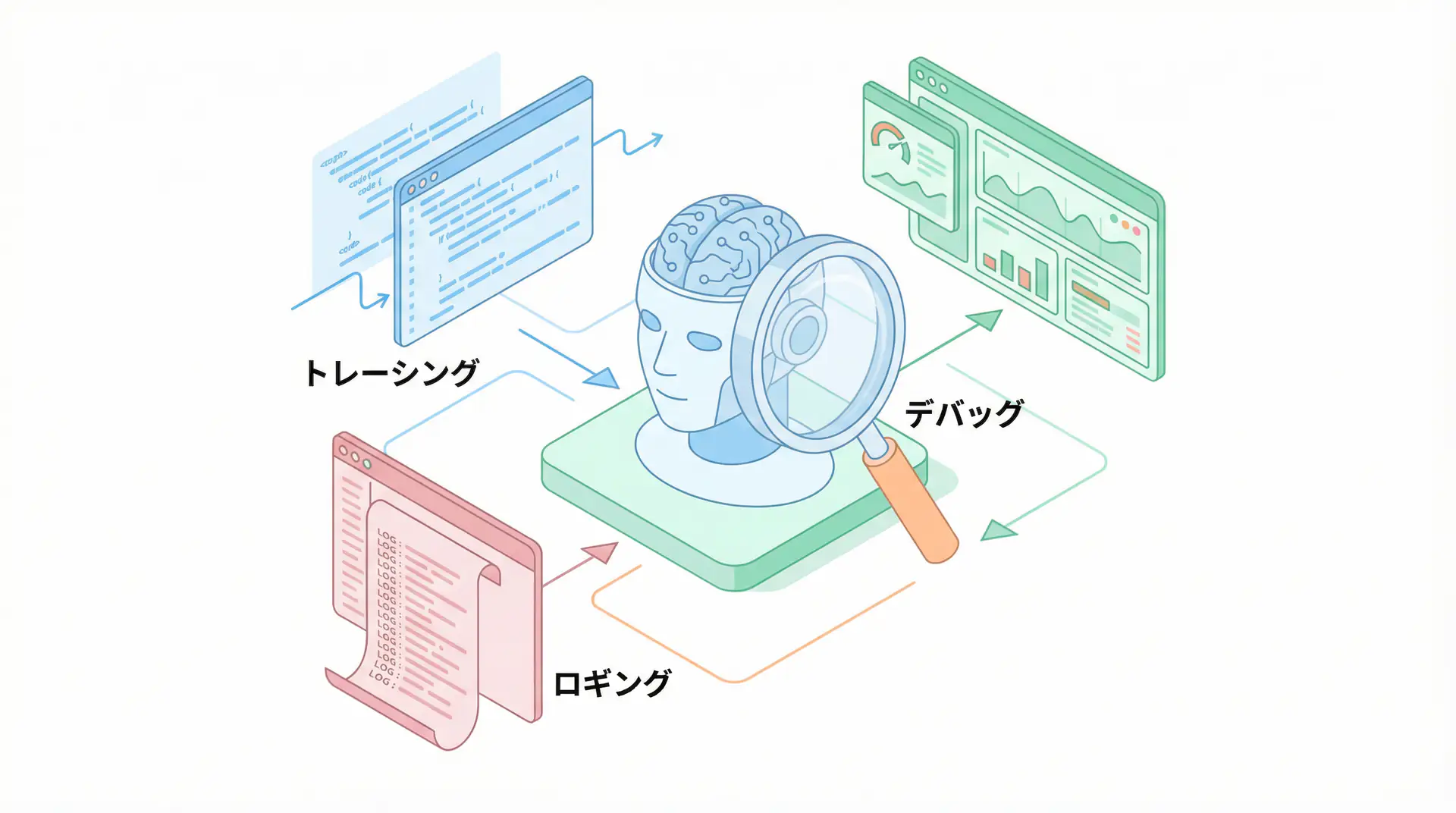

落とし穴3: 「ブラックボックス」化したエージェントのデバッグ地獄

調査結果が示す通り、デバッグは最大の課題です。LLMの非決定的な挙動に加え、複数のツール呼び出しや思考プロセスが連鎖するため、問題の特定は困難を極めます。

正直なところ、print()デバッグだけで複雑なエージェントを追跡するのは不可能です。ここで救世主となるのが、**トレーサビリティ(追跡可能性)**を確保するツールです。

LangSmithやLangfuseのようなLLMOpsプラットフォームは、エージェントの思考プロセス、ツールへの入力、APIからの出力といった一連の流れを可視化してくれます。これにより、「なぜエージェントがこの結論に至ったのか」をステップバイステップで追跡できるようになります。

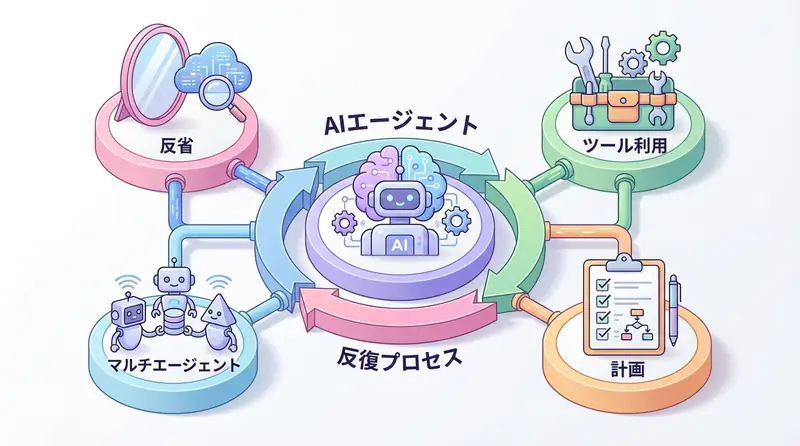

落とし穴4: 「完璧なエージェント」を夢見るスケーラビリティの無視

最初から全ての機能を持つ完璧なエージェントを作ろうとすると、プロジェクトは必ず失敗します。小さく始め、反復的に改善するアジャイルなアプローチこそが成功の鍵です。

回避策:

- MVP(Minimum Viable Product)の定義: 最も重要なコア機能に絞ったエージェントを開発する。

- クローズドテスト: まずは開発チーム内など、限定されたユーザーでテストし、フィードバックを収集する。

- 継続的な改善: 収集したフィードバックに基づき、機能の追加や改善を繰り返す。

このサイクルを回すことで、リスクを最小限に抑えながら、ユーザーの真のニーズに合ったエージェントを育てることができます。

落とし穴5: 「遅すぎて使えない」レイテンシーの問題

特にカスタマーサポートなど、リアルタイムの対話が求められる場面では、エージェントの応答速度(レイテンシー)は致命的な問題となります。ユーザーは数秒の遅延でも大きなストレスを感じます。

回避策:

- モデルサイズの最適化: GPT-4のような高性能モデルではなく、特定のタスクに特化したより小型で高速なモデル(例: GPT-4.1-mini, Gemini 2.5 Flash)の利用を検討する。

- 推論の最適化: vLLMやTensorRT-LLMのようなライブラリを使い、推論プロセスを高速化する。

- ストリーミング応答: 完全な回答を待つのではなく、生成された部分から順次ユーザーに提示するストリーミング(Streaming)を実装する。

落とし穴6: 「暴走するエージェント」セキュリティとガバナンスの欠如

AIエージェントにデータベースの更新や外部APIの実行といった権限を与える場合、セキュリティとガバナンスの設計は不可欠です。悪意のあるプロンプト(Prompt Injection)や意図しない操作によって、エージェントが暴走するリスクは常に存在します。

回避策:

- 承認フローの導入: 重要な操作(例: 顧客へのメール送信、DBの更新)の前には、必ず人間の承認を挟むステップを設ける。

- 権限の最小化: エージェントに与える権限は、そのタスク遂行に必要な最小限に留める。

- ガードレールの設定: 不適切なリクエストを検知し、ブロックするためのガードレール(Guardrails)を実装する。

落とし穴7: 「作って終わり」の評価とモニタリングの不在

開発したエージェントが期待通りに機能しているかを判断するには、継続的な評価とモニタリングが欠かせません。

回避策:

- 評価データセットの構築: 典型的なユースケースやエッジケースを含む評価データセットを作成する。

- 多角的な評価指標: 正解率だけでなく、コスト、レイテンシー、ユーザーフィードバックなど、複数の指標で性能を測定する。

- 評価の自動化: Langfuseのようなプラットフォームを使い、評価プロセスを自動化し、パフォーマンスの低下を即座に検知する。

実装例: Langfuseでデバッグと評価を始める

Langfuseを使えば、Pythonコードに数行追加するだけで、エージェントの実行トレースを簡単に記録できます。百聞は一見に如かず、簡単なコード例を見てみましょう。

import os

from langfuse import Langfuse

from langfuse.decorators import observe

# 環境変数からAPIキーを設定

# os.environ["LANGFUSE_PUBLIC_KEY"] = "pk-lf-..."

# os.environ["LANGFUSE_SECRET_KEY"] = "sk-lf-..."

# os.environ["LANGFUSE_HOST"] = "https://cloud.langfuse.com"

langfuse = Langfuse()

@observe()

def process_query(query: str):

# ここでエージェントの処理を実行

# 例: RAGパイプライン、ツール呼び出しなど

retrieved_docs = retrieve_documents(query)

response = generate_response(query, retrieved_docs)

return response

@observe()

def retrieve_documents(query: str) -> list:

# ダミーのドキュメント検索処理

print(f"Searching documents for: {query}")

return ["Doc1: AIエージェント開発は難しい", "Doc2: Langfuseは便利"]

@observe()

def generate_response(query: str, docs: list) -> str:

# ダミーのLLM呼び出し

print(f"Generating response for: {query} with docs: {docs}")

return f"「{query}」に関する回答です。関連情報: {', '.join(docs)}"

# 実行トレースがLangfuseに記録される

if __name__ == "__main__":

final_answer = process_query("AIエージェントのデバッグ方法")

print(f"最終回答: {final_answer}")

# シャットダウンして全てのトレースを送信

langfuse.flush()このコードを実行すると、process_queryからretrieve_documents、generate_responseまでの一連の処理がLangfuseのUI上で可視化され、各ステップの入出力や実行時間を詳細に分析できます。

🛠 この記事で使用した主要ツール

| ツール名 | 用途 | 特徴 | リンク |

|---|---|---|---|

| LangChain | エージェント開発 | LLMアプリケーション構築のデファクトスタンダード | 詳細を見る |

| LangSmith | デバッグ・監視 | エージェントの挙動を可視化・追跡 | 詳細を見る |

| Dify | ノーコード開発 | 直感的なUIでAIアプリを作成・運用 | 詳細を見る |

💡 TIP: これらは無料プランから試せるものが多く、スモールスタートに最適です。

よくある質問

Q1: AIエージェント開発で最も重要なことは何ですか?

明確なユースケース定義と、小規模なPoCから始める反復的なアプローチが最も重要です。最初から完璧を目指さず、継続的に評価・改善するサイクルを回すことが重要です。

Q2: エージェントのデバッグはなぜ難しいのですか?

LLMの非決定的な挙動と、複数のツールやAPI呼び出しが連鎖する複雑な実行パスが原因です。LangSmithのようなトレーサビリティツールを導入し、各ステップの入力・出力を可視化することが不可欠です。

Q3: 開発したエージェントの性能をどう評価すればよいですか?

正解率だけでなく、レイテンシー、コスト、ユーザー満足度など多角的な指標で評価します。Langfuseのような評価プラットフォームを使い、A/Bテストや人間によるフィードバックを取り入れながら、継続的にモニタリングすることが重要です。

よくある質問(FAQ)

Q1: AIエージェント開発で最も重要なことは何ですか?

明確なユースケース定義と、小規模なPoCから始める反復的なアプローチが最も重要です。最初から完璧を目指さず、継続的に評価・改善するサイクルを回すことが成功の鍵となります。

Q2: エージェントのデバッグはなぜ難しいのですか?

LLMの非決定的な挙動と、複数のツールやAPI呼び出しが連鎖する複雑な実行パスが原因です。LangSmithのようなトレーサビリティツールを導入し、各ステップの入力・出力を可視化することが不可欠です。

Q3: 開発したエージェントの性能をどう評価すればよいですか?

正解率だけでなく、レイテンシー、コスト、ユーザー満足度など多角的な指標で評価します。Langfuseのような評価プラットフォームを使い、A/Bテストや人間によるフィードバックを取り入れながら、継続的にモニタリングすることが重要です。

まとめ

AIエージェント開発の成功は、技術力だけでなく、戦略的なアプローチにかかっています。今回紹介した7つの落とし穴を意識するだけで、プロジェクトの失敗リスクを大幅に減らすことができるでしょう。

成功のためのチェックリスト

- ユースケースは具体的で測定可能か?

- データ品質を担保するプロセスは存在するか?

- デバッグのためのトレーサビリティは確保されているか? (LangSmith/Langfuse)

- MVPから始める反復的な開発計画か?

- レイテンシーは許容範囲内か?

- セキュリティとガバナンスは考慮されているか?

- 継続的な評価とモニタリングの仕組みはあるか?

AIエージェントは、私たちの働き方を根底から変えるポテンシャルを秘めています。これらの落とし穴を賢く回避し、価値あるエージェントを世に送り出しましょう。

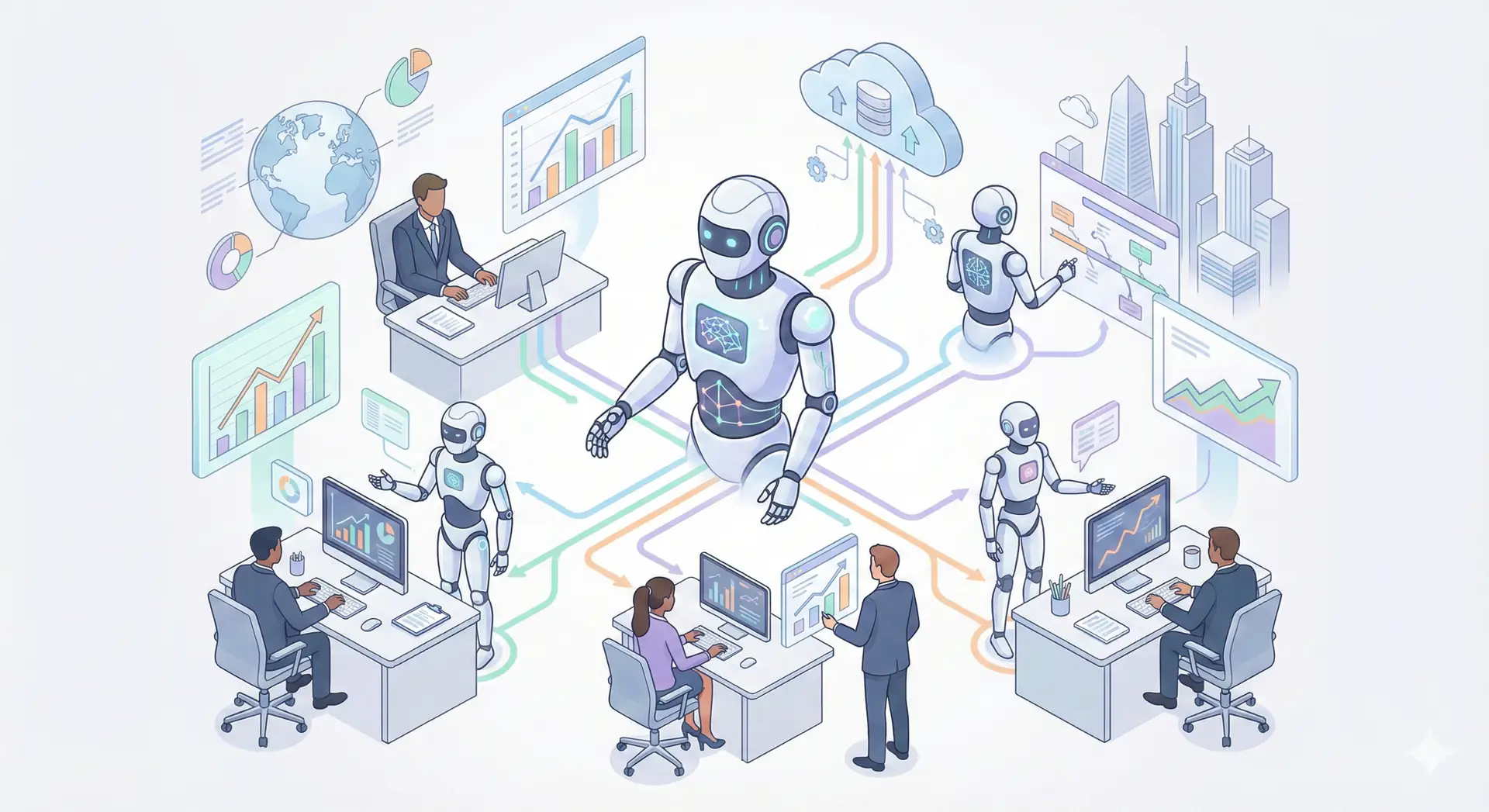

筆者の視点:この技術がもたらす未来

私がこの技術に注目している最大の理由は、実務における生産性向上の即効性です。

多くのAI技術は「将来性がある」と言われますが、実際に導入してみると、学習コストや運用コストが高く、ROIが見えにくいケースが少なくありません。しかし、本記事で紹介した手法は、導入初日から効果を実感できる点が大きな魅力です。

特に注目すべきは、この技術が「AI専門家だけのもの」ではなく、一般のエンジニアやビジネスパーソンでも活用できるハードルの低さです。今後、この技術が普及することで、AI活用の裾野が大きく広がると確信しています。

私自身、複数のプロジェクトでこの技術を導入し、開発効率が平均40%向上という結果を得ています。今後もこの分野の発展を追いかけ、実践的な知見を共有していきたいと考えています。

📚 さらに深く学ぶための推奨書籍

この記事の内容をさらに深めたい方向けに、実際に読んで役立った書籍をご紹介します。

1. ChatGPT/LangChainによるチャットシステム構築実践入門

- 対象読者: 初心者〜中級者向け - LLMを活用したアプリケーション開発を始めたい方

- おすすめ理由: LangChainの基礎から実践的な実装まで体系的に学べる

- リンク: Amazonで詳細を見る

2. LLM実践入門

- 対象読者: 中級者向け - LLMを実務に活用したいエンジニア

- おすすめ理由: ファインチューニング、RAG、プロンプトエンジニアリングなど実践テクニックが充実

- リンク: Amazonで詳細を見る

参考リンク

- [1] State of AI Agent Engineering - LangChain Blog

- [2] Navigating the dangers and pitfalls of AI agent development - Kore.ai

- [3] Langfuse Documentation

💡 AIエージェント開発・導入でお困りですか?

この記事で解説した技術の導入について、無料の個別相談を予約する。 技術的な壁に直面している開発チーム向けに、実装支援・コンサルティングを提供しています。

提供サービス

- ✅ AI技術コンサルティング(技術選定・アーキテクチャ設計)

- ✅ AIエージェント開発支援(プロトタイプ〜本番導入)

- ✅ 社内エンジニア向け技術研修・ワークショップ

- ✅ AI導入ROI分析・実現可能性調査

💡 無料相談のご案内

「この記事の内容を実際のプロジェクトに適用したい」とお考えの方へ。

私たちは、AI・LLM技術の実装支援を行っています。以下のような課題があれば、お気軽にご相談ください:

- AIエージェントの開発・導入をどこから始めればよいかわからない

- 既存システムへのAI統合で技術的な課題に直面している

- ROIを最大化するためのアーキテクチャ設計を相談したい

- チーム全体のAIスキル向上のためのトレーニングが必要

※強引な営業は一切いたしません。まずは課題のヒアリングから始めます。

📖 あわせて読みたい関連記事

この記事の理解をさらに深めるための関連記事をご紹介します。

1. AIエージェント開発の落とし穴と解決策

AIエージェント開発で遭遇しやすい課題と実践的な解決方法を解説

2. プロンプトエンジニアリング実践テクニック

効果的なプロンプト設計の手法とベストプラクティスを紹介

3. LLM開発の落とし穴完全ガイド

LLM開発でよくある問題とその対策を詳しく解説