LLM(大規模言語モデル)を活用した開発に携わっていると、必ずと言っていいほど「金魚のような記憶力」という壁にぶつかります。いくら高性能なモデルを使っていても、セッションが切れればすべてはリセットされ、コンテキストウィンドウ(一度に処理できる情報量)の制限を超えた過去の会話は、水泡のように消えてしまうのです。

私も以前、複雑なコードベースを解析させるエージェントを開発した際、過去に指摘したバグの修正方針をモデルが忘れてしまい、同じ議論を何度も繰り返すという事態に直面しました。これは単なる不便さではありません。エージェントに「自律的な作業」をさせるための決定的なボトルネックです。

この課題を解決するのが、 Agentic Memory(エージェント型記憶) という仕組みです。単に過去のログを保存するだけでなく、エージェントが必要な情報を「想起」し、そこから「学習」するための構造化された記憶層を提供します。本記事では、状態を持たないLLMの限界をどう超えるか、その技術的な背景と具体的な実装コード、そしてビジネスへの応用までを深掘りしていきます。

状態なきエージェントの限界と記憶の必要性

従来のチャットボット型AIは、基本的に Stateless(状態なき) です。ユーザーが「こんにちは」と言い、ボットが「こんにちは」と返す。そのやり取りが終われば、ボットはその会話が存在したことすら忘れてしまいます。これは、LLMが確率的に次の単語を予測する計算機であり、内部に永続的なストレージを持たないことに起因します。

しかし、私たちがエンジニアに期待する「エージェント」の振る舞いは、もっと高度です。「昨日の議論を踏まえて」「このプロジェクトの過去の傾向から」といった文脈を考慮し、時間軸を跨いだ判断を下してほしいと考えます。

ここで登場するのがAgentic Memoryです。これは人間の記憶プロセスを模倣したアーキテクチャとして設計されています。

- 感覚記憶: 入力されたデータの一時的な保持。

- 短期記憶: 現在のタスク実行に必要な情報(コンテキストウィンドウ内)。

- 長期記憶: 過去の経験、知識、ユーザー設定などを永続化したストレージ(ベクトルDBなど)。

Agentic Memoryを実装することで、LLMは単なる「計算機」から「経験を積むパートナー」へと進化します。なぜ今これが必要かと言えば、AIの活用領域が「単発のQ&A」から「継続的なプロセスの自動化」へとシフトしているからです。プロセスが続く限り、過去の履歴は資産であり、それを活用しない手はありません。

Agentic Memoryの技術的アーキテクチャ

技術的な観点から見ると、Agentic Memoryは単なるデータベースへの保存/読み込みではありません。 「何を記憶し、何を忘れ、いつ想起するか」 を判断する知能が必要です。

一般的な実装パターンでは、以下のコンポーネントが連携します。

- Embeddingモデル: テキストデータをベクトル化し、意味的な類似性を計算可能にする。

- Vector Store: ベクトルデータを高速に検索・保存するデータベース(ChromaDB, Pinecone, pgvectorなど)。

- 重要性スコアリング: 保存する情報に優先順位をつけ、ノイズとなる情報を排除するフィルタリング機能。

- 記憶ストリーム: 時系列順にイベントを記録し、要約や圧縮を行う仕組み。

特に重要なのが 「想起(Retrieval)」 のタイミングです。ユーザーからの新しい入力がある際、エージェントは即座に回答を生成するのではなく、まず長期記憶を検索します。この検索クエリ自体も、LLMを使って最適化されることが多いです。「このユーザーの質問に対して、過去のどのような情報が関連性が高いか」をLLM自身に判断させるのです。

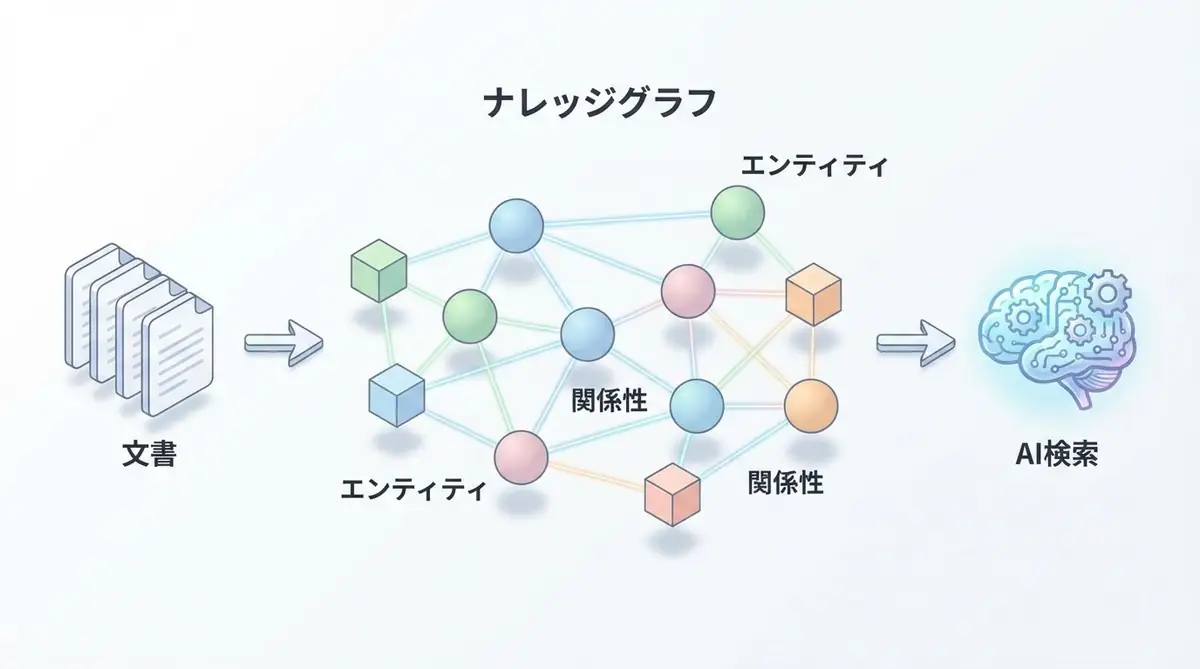

このアーキテクチャを図にすると、以下のようなフィードバックループが形成されます。エージェントが行動し、その結果を記憶し、次の行動に活かすという循環こそが、Agentic Memoryの核心です。

実装例:Pythonによる学習機能付きエージェント

それでは、具体的なコードを見ていきましょう。ここでは、Pythonの langchain ライブラリとローカルで動作可能な ChromaDB を使用し、ユーザーの指摘を記憶して次回から反映する簡単なエージェントを実装します。

このコードは「Hello World」的な動作ではなく、エラーハンドリングやロギング、そしてベクトル検索を含む実用的な構造になっています。

事前準備

必要なライブラリをインストールします。

pip install langchain langchain-openai langchain-community chromadbソースコード

import logging

from typing import List, Optional

from datetime import datetime

from langchain_openai import OpenAIEmbeddings, ChatOpenAI

from langchain_chroma import Chroma

from langchain.schema import HumanMessage, SystemMessage, AIMessage

from langchain.memory import VectorStoreRetrieverMemory

# ロギングの設定

logging.basicConfig(

level=logging.INFO,

format='%(asctime)s - %(levelname)s - %(message)s'

)

logger = logging.getLogger(__name__)

class AgenticMemoryAssistant:

def __init__(self, persist_directory: str = "./db"):

"""

Agentic Memoryを持つアシスタントの初期化。

ベクトルDBとLLMのセットアップを行います。

"""

try:

# 埋め込みモデルの初期化 (OpenAIのtext-embedding-3-small等を想定)

self.embeddings = OpenAIEmbeddings()

# ベクトルストアの初期化

self.vectorstore = Chroma(

collection_name="agent_memory",

embedding_function=self.embeddings,

persist_directory=persist_directory

)

# 検索機能の設定 (上位3件を取得)

retriever = self.vectorstore.as_retriever(search_kwargs={"k": 3})

# LangChainのMemory機能をラップ

self.memory = VectorStoreRetrieverMemory(retriever=retriever)

# LLMの初期化 (GPT-4o等を想定)

self.llm = ChatOpenAI(model="gpt-4o", temperature=0)

logger.info("AgenticMemoryAssistant initialized successfully.")

except Exception as e:

logger.error(f"Initialization failed: {e}")

raise

def _get_contextual_prompt(self, input_text: str) -> str:

"""

過去の記憶を検索し、現在のコンテキストに合わせてプロンプトを構築する。

"""

try:

# 過去の関連記憶を取得

relevant_memories = self.memory.load_memory_variables({"prompt": input_text})

history = relevant_memories.get("history", [])

context_str = "\n".join([f"- {mem}" for mem in history])

system_prompt = f"""あなたは親切で学習能力のあるAIアシスタントです。

過去のユーザーとのやり取りや指摘を記憶しており、それに基づいて回答を調整します。

【過去の記憶(参考情報)】

{context_str if context_str else "まだ関連する記憶はありません。"}

上記の記憶を踏まえて、現在のユーザーの質問に答えてください。

もし記憶にある情報と矛盾する指示があれば、最新のユーザーの意図を優先しつつ、

過去の文脈も考慮して丁寧に説明してください。"""

return system_prompt

except Exception as e:

logger.warning(f"Context retrieval failed: {e}. Proceeding without context.")

return "あなたは親切なAIアシスタントです。"

def chat(self, user_input: str) -> str:

"""

ユーザーとの対話を行い、結果を記憶に保存する。

"""

try:

logger.info(f"User Input: {user_input}")

# 1. コンテキストの取得とプロンプト構築

system_prompt = self._get_contextual_prompt(user_input)

messages = [

SystemMessage(content=system_prompt),

HumanMessage(content=user_input)

]

# 2. LLMによる回答生成

response = self.llm.invoke(messages)

ai_response = response.content

logger.info(f"AI Response: {ai_response}")

# 3. 記憶の保存 (学習プロセス)

# ユーザーの入力とAIの回答をペアで保存することで、文脈を記録

self.save_memory(user_input, ai_response)

return ai_response

except Exception as e:

logger.error(f"Error during chat execution: {e}")

return "申し訳ありません。処理中にエラーが発生しました。"

def save_memory(self, input_text: str, output_text: str):

"""

対話内容をベクトルDBに保存する。

ここでは単純化のため、ユーザーの指摘を重要な記憶として扱う。

"""

try:

# 保存するテキストを作成 (ユーザー入力とAI回答のペア)

memory_content = f"User: {input_text}\nAssistant: {output_text}"

# ベクトルDBに追加

self.vectorstore.add_texts(

texts=[memory_content],

metadatas=[{"timestamp": datetime.now().isoformat()}]

)

logger.info("Memory saved successfully.")

except Exception as e:

logger.error(f"Failed to save memory: {e}")

# 実行例

if __name__ == "__main__":

# 環境変数 OPENAI_API_KEY が設定されている前提

try:

assistant = AgenticMemoryAssistant()

print("--- 1回目の対話 ---")

res1 = assistant.chat("コードを書く時は、変数名はスネークケースで統一してください。")

print(f"Bot: {res1}\n")

print("--- 2回目の対話 (記憶の確認) ---")

res2 = assistant.chat("ユーザー情報を管理するクラスを作成してください。")

print(f"Bot: {res2}\n")

# 期待される動作: 2回目の回答では、1回目の指示(スネークケース)を反映したコードが出力されるはずです。

except KeyError:

print("Error: OPENAI_API_KEY environment variable is not set.")

except Exception as e:

print(f"An unexpected error occurred: {e}")このコードのポイントは save_memory メソッドと _get_contextual_prompt メソッドの連携にあります。ユーザーが「スネークケースで書いてくれ」と指示した瞬間、そのテキストはベクトル化され保存されます。次にクラスを作成するよう依頼された際、ベクトル検索が過去の指示を引っ張り出し、システムプロンプトに注入されます。これにより、LLMは明示的に再指示されなくても、過去の文脈を守るコードを生成するようになります。

ビジネスユースケース:カスタマーサポートにおける自己進化型ボット

この技術が最も威力を発揮するのは、カスタマーサポート領域です。

従来のFAQボットは、事前に登録された知識ベースからしか回答できませんでした。しかし、Agentic Memoryを導入したサポートボットは以下のような運用が可能になります。

- 初期段階: 製品マニュアルをベースに回答する。

- 例外の発生: ユーザーから「マニュアルにはこう書いてあるが、実際にはこの設定で動いた」といった、いわゆる「裏技」や「現場の知恵」が投稿される。

- 記憶と学習: ボットはこのやり取りを長期記憶に保存する。正確性を高めるため、特定の条件下でのみその情報を参照するようにメタデータを付与することも可能。

- 自己進化: 次回から同様の問い合わせに対し、単なるマニュアルの文言ではなく、現場で検証された解決策を提案できるようになる。

これにより、サポート担当者は頻繁に発生する「マニュアルに載っていないトラブル」の対応に追われる時間を削減でき、ボット自体の解決率(CSAT)も時間経過とともに向上していきます。これは静的なシステムでは決して実現できない、動的な価値です。

よくある質問

Q: Agentic Memoryと従来のRAGは何が違うのですか?

A: 従来のRAGが静的なドキュメント検索に主眼を置いているのに対し、Agentic Memoryは対話の文脈やユーザーのフィードバックを動的に保存・更新し、エージェント自身の行動方針を変化させる「学習」のプロセスを含みます。RAGは「知識の参照」ですが、Agentic Memoryは「経験の蓄積」です。

Q: ベクトルデータベース以外にどのような技術が必要ですか?

A: ベクトルデータベースに加え、記憶の重要度を判定するスコアリング機構や、長期・短期・作業記憶を振り分けるアーキテクチャ、そしてLLMとの連携インターフェースが必要です。

Q: 導入における最大の課題は何ですか?

A: 検索精度の維持とコスト管理です。記憶量が増えると検索ノイズが増え、LLMのコンテキスト消費も激増するため、適切な記憶の圧縮・忘却戦略が求められます。

まとめ

- 状態なきLLMの限界: セッションを跨いだ学習ができず、コンテキスト制限があるため、継続的なタスクには不向き。

- Agentic Memoryの役割: 人間の記憶プロセス(短期・長期)を模倣し、過去の経験を検索・利用可能にする仕組み。

- 実装のポイント: ベクトルDBによる意味検索と、LLMによる文脈判断を組み合わせることで、動的な学習ループを構築可能。

- ビジネス価値: カスタマーサポートやコードアシスタントなど、時間経過とともにパフォーマンスが向上するアプリケーションを実現する。

推奨リソース

- 書籍: 『Building Applications with LLMs』(O’Reilly)

- RAGやエージェント設計のパターン網羅的に解説されており、Architectural decisionの参考になります。

- ツール: LangChain

- PythonおよびJavaScriptでAgentic Memoryを構築するためのデファクトスタンダードなライブラリです。

AI導入支援・開発のご相談

貴社の業務プロセスに最適なAIエージェントの設計・開発から導入支援まで、弊社エンジニアが全面的にサポートします。まずは気軽にご相談ください。

参考リンク

[1] LangChain Memory Documentation [2] ChromaDB Documentation